获取完整原文和代码,公众号回复:1902.09103

论文地址: https://arxiv.org/abs/1902.09103v1.pdf

代码: 公众号回复:1902.09103

来源: 香港科技大学, 腾讯YouTu实验室

论文名称:Beyond Photometric Loss for Self-Supervised Ego-Motion Estimation

原文作者:Tianwei Shen

内容提要

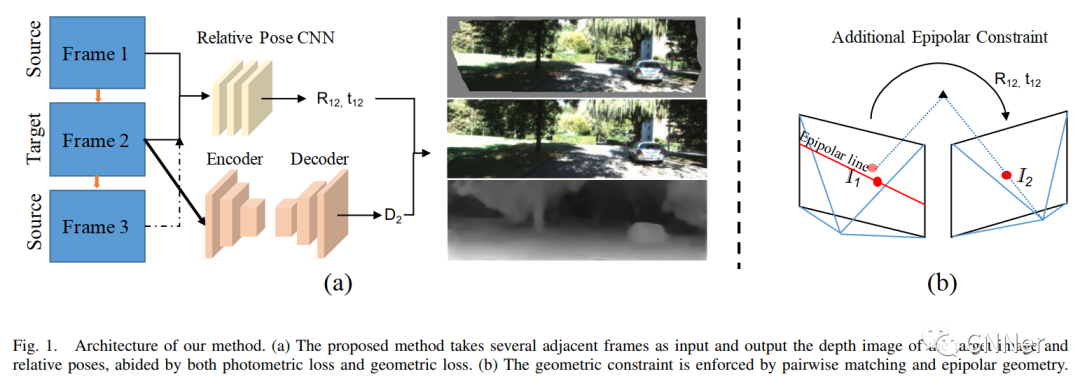

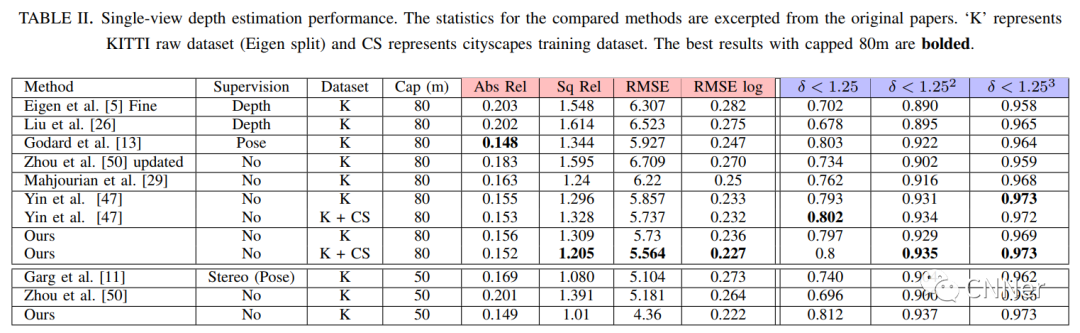

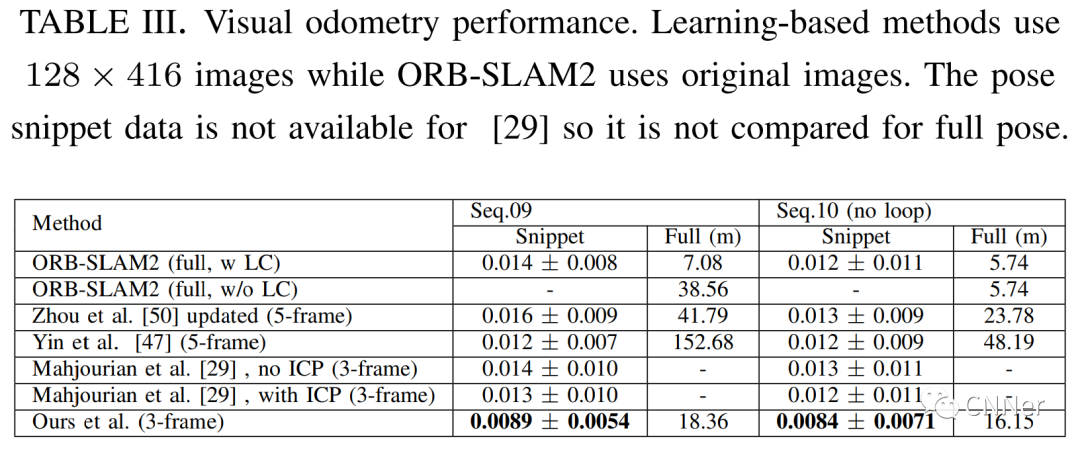

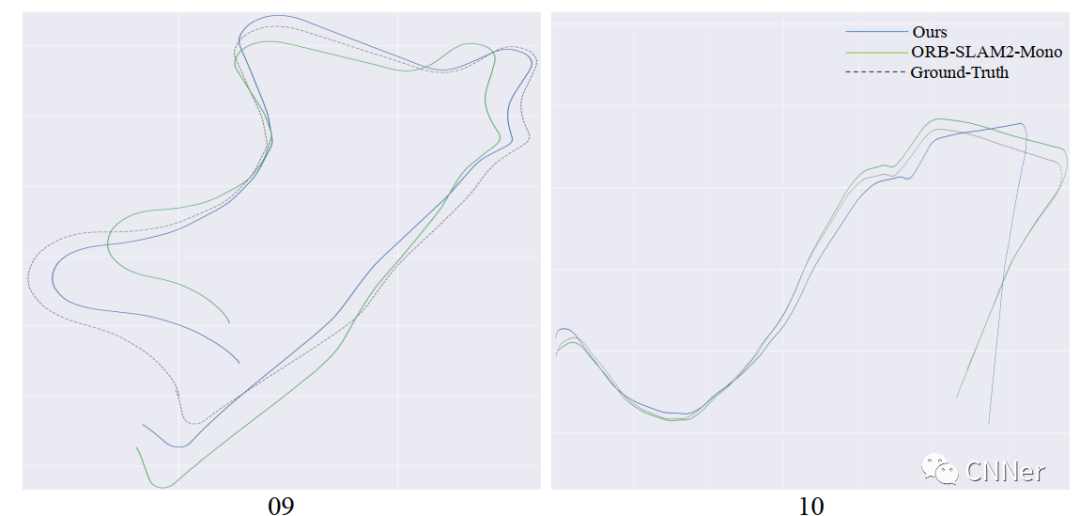

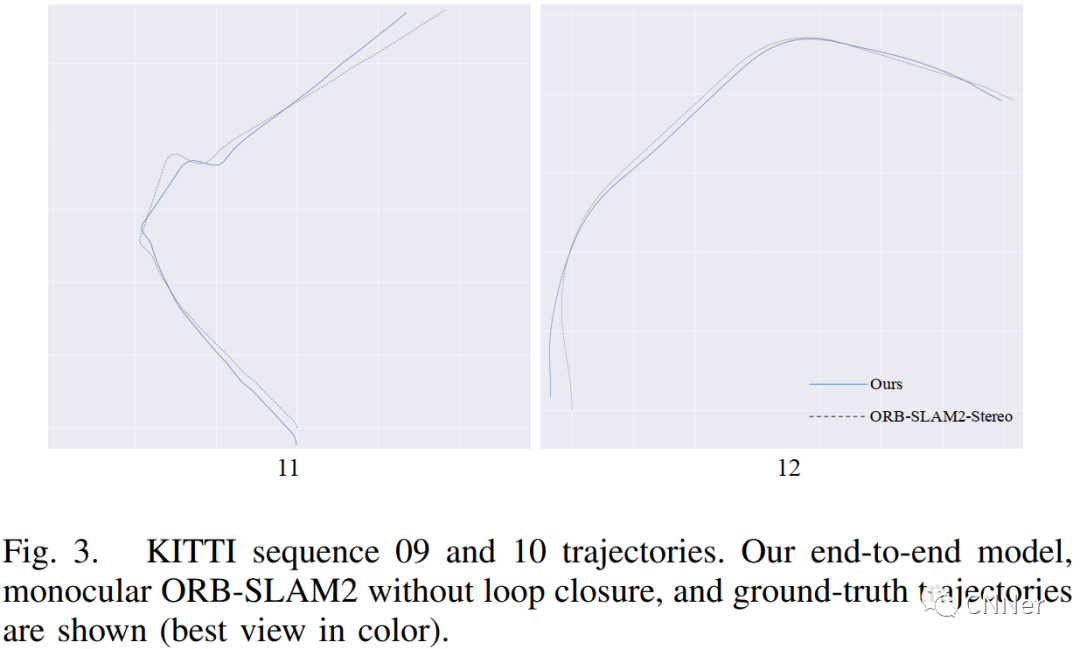

精确的相对姿势是视觉里程计(VO)和SLAM的关键组成部分之一。近年来,合优化相对姿态和目标图像深度的自监督学习框架引起了社会各界的关注。以前的工作依赖于相邻帧之间的深度和姿态产生的光度误差,这在现实场景中由于反射表面和遮挡造成了很大的系统误差。在本文中,我们在一个自监督的框架中引入了受极几何约束的匹配损耗,从而弥补了几何损耗和光度损耗之间的差距。在KITTI数据集上进行评估,我们的方法大大优于最新的无监督自我运动估计方法。

主要框架及实验结果

声明:文章来自于网络,仅用于学习分享,版权归原作者所有,侵权请加上文微信联系删除。