大数据文摘出品

作者:刘俊寰

视频时代正在到来。

本周发布的《2019抖音数据报告》指出,抖音日活跃用户数已突破4亿;而在全球范围内,根据YouTube在2019年公布的数据,其日活跃用户数已经突破了19亿。

大量视频内容涌现的同时,暴力、色情内容也随之进入互联网,成为用户视频浏览中的“定时炸弹”。

在这个AI赋能一切的时代,人工智能似乎正在视频内容的审核中大展拳脚。

2018年,Facebook推出DeepText,利用深层神经网络架构理解内容;而YouTube早就推出了Content ID,监测并删除涉及色情和暴力等违规视频,多年来在该技术上花费了超过1亿美元。甚至不少媒体都预言,AI将凭借着其对海量数据的组织能力,不久后会取代人工审核。

但事实真的如此吗?

近日,知名海外科技媒体TheVerge到访谷歌位于美国奥斯汀的人工内容审核师团队,报道了团队成员因为大量审核暴力内容遭受的可怕精神创伤。

Youtube的视频审核决不是一项简单的工作。

目前,全球共有约5000万YouTube独立创作者,每分钟上传的视频时长高达500小时,这给视频审核师们带来了极大的工作压力。

谷歌位于奥斯丁的审核师总数目前超过百人,他们主要负责审核具有暴力色情等极端视频,同时,审核团队还配备有数十名来自中东的低薪移民进行工作上的协助。

为了保证效率,奥斯汀的内容审核团队每人每天必须观看5小时以上的暴力色情视频,审核人员时薪为18.50美元,年薪约37,000美元,但近两年没有加薪。YouTube首席执行官苏珊·沃西基(Susan Wojcicki)向媒体透露,谷歌去年曾承诺将内容审核师每人每天的工作量减少到4个小时,但至今仍未被执行。

由于长时间暴露在极端视频之下,谷歌团队的审核师们被曝遭受着严重的心理创伤。尽管谷歌为审核师们提供了一流的医疗服务和福利,但是不少审核师还是会被检测出罹患PTSD、长期焦虑等精神问题。

注:PTSD,全称为创伤后应激障碍,是指个体经历、目睹或遭遇到一个或多个涉及自身或他人的实际死亡,或受到死亡的威胁,或严重的受伤,或躯体完整性受到威胁后,所导致的个体延迟出现和持续存在的精神障碍。

视频审核师每天都在看什么?

在文摘菌的印象中,审核师的工作就是看看用户上传到网站的视频,大概就像是…每天刷刷抖音就能轻松挣钱一样,可以说是梦寐以求的工作了。

但不管是YouTube还是国内,视频审核都没有文摘菌想象的这么美好。

在知乎上,相关话题的浏览量已经达到了167951次,其中网友@white举例说道,“ISIS杀戮人质的视频让我狼狈不堪,非洲人民凶残的一面让我感到害怕,美国黑人区发生的让我感到惶恐,美国天黑时散发出恐怖的色彩!可能人类的本质就是杀戮,被割喉的人疯狂的挣扎,暗红色的血液缓缓慢流动出来,日本自杀深林中令人作呕的尸体……”

知乎话题链接:

https://www.zhihu.com/question/24738486

同样,作为YouTube的内容审核师,他们的工作并没有轻松到哪去。

YouTube的内容审核师Peter告诉TheVerge,他每天负责的就是极端暴力(violent extremism)的视频审核,这可以说是整个审核工作中最致郁的一个板块,正如上文提到谷歌为审核团队制定了严格的工作计划,他必须看足够量的暴力色情视频。

“每天你都会看到有人砍人,或者射杀亲友,”Peter说,“你会觉得,这个世界很疯狂,这会让你感到不舒服,甚至不想继续活下去。我们到底为什么要这样对待彼此呢?”

在过去一年里,Peter和同事们的生活都受到了极大的影响。一位同事患上了神经衰弱,还有一位同事因工作中的焦虑和抑郁而痛苦不堪,饮食和作息逐渐紊乱,最后患上了急性维生素缺乏症,不得不住院接受治疗。

不止是Peter和同事们,另一位视频审核师Daisy曾负责Google视频中的恐怖主义和儿童虐待内容的审核,从事这项工作后,她曾一度难以和孩子交流互动。在接受精神科专家诊断后,她被确诊患有PTSD,至今仍在接受治疗。

根据报道,审核师在申请工作的时候通常并不了解极端视频会对身心造成怎样的伤害,而就YouTube的审核师所透露的内容来看,谷歌向应聘者所说明的审核数量和工作要求往往是过低的。

虽然谷歌为全职审核师制定了相关的医疗保健标准,他们可以休假数月,以解决严重影响工作与生活的心理问题,但这只是谷歌内部被报道的情况,全球范围内还有更多未被报道的内容审核师遭受了心理创伤后被公司无情忽视。

AI能拯救视频审核师吗?

AI参与视频审核并非近几年才有,最早2000年左右,就有公司在做这方面的尝试。但那时,视频审核需要人为设定特征和规则,比如黄颜色皮肤面积分布情况。一直到深度学习得到发展后,视频审核才终于变得“灵活”了。

但是,在视频审核上,目前业内普遍采用的仍然是“人机结合”的方式,并且人工在其中占据着重要比例。

YouTube的算法工程师向文摘菌透露,目前YouTube上大部分视频仍需要经过人工审核,被审核视频一部分是AI检测出来,一部分是用户举报的,但最终都需要专业的审核师把关决定是否违规。

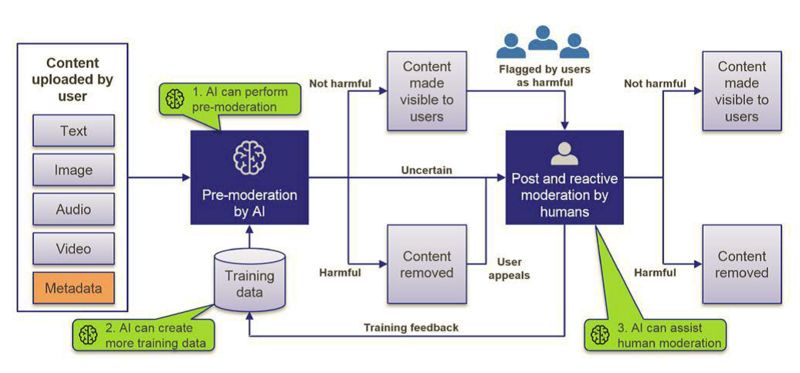

根据爱奇艺算法工程师Leo的介绍,目前业内有以下两种比较常见的“人机配合”审核方式:

- 一种AI将相对确定的视频进行分类,然后对部分用户做出推荐,观察用户反应,其中高热视频会人工率先审核;

- 另一种是AI将视频标记为“good”或“bad”,当审核师遇到标注有“bad”视频时再细致地审核,这也提高了审核效率。

爱奇艺目前采取的是第二种模式。视频会先经过机审预判,然后再进行人工一审和复审,其中机审结果主要作为参考辅助人工,另外还有视频清查机制。

针对AI取代人工审核的说法,Leo认为还为时过早,虽然AI在客观视频的审核上做得足够好,但一旦涉及与语境语义相关的主观内容,就捉襟见肘了。

AI审核存在两个技术难点,一个是算法准确率问题。在业内有句话,“脱离数据集来谈准确率都是耍流氓”,这就是说,用数据集训练出来的AI模型并不都能匹配实际行为,还存在用户行为偏差等诸多影响因素,即使AI审核的准确率达到了99%,考虑到用户上传的视频量,剩下1%的累计量也是惊人的。

而一旦出现疏漏,视频网站将承受巨大的风险。

另一个难关就是对内容的主观判断。简单来说,不是所有露骨的内容都是色情,也不是所有色情视频都有裸露,再加上视频内容中涉及到的文字、语音等多方面情景混杂,对人来说较容易判断,但对机器而言需要多个算法叠加。

Leo告诉我们,比如在处理音频内容时,一方面需要利用ASR转化成文本,另一方面需要对声音分类,这就包括一些无意义的音频,比如娇喘声。如果画面中还出现了文字,需要借助OCR把文字从视频中抠出来,但最终都要利用NLP,也就是文本理解。

因此,人工审核在整个审核领域仍然是至关重要的一环。爱奇艺配置的专业审核团队主要负责甄别用户上传视频的内容,将不符合国家法律法规、平台标准的内容筛除。

定义敏感内容?AI:臣妾做不到啊

对AI审核而言,除去上述的准确率和内容主观判定对AI而言仍然无解之外,对敏感内容的界定本身尚未清晰也是一个不可忽视的重要原因。

在国内,违规内容一般统一由广电总局统一规范,视频网站在规则界定上显得被动,他们需要根据广电总局指定的标准进行严格的自审,甚至有些公司会成立专门的法务咨询岗位,专门研究广电总局的政策。

而在全球范围内,更多的视频网站承担着自行定义敏感内容的职责。但也正因为有更大的主动性,他们就承担更大的责任。想要全球范围内统一的审核标准无疑是一项非常棘手的工作,如果没有考虑到当地文化因素,严重情况下视频网站会陷入与政府和民众的苦战中。

比如,2018年7月,印尼政府禁止了流行的短音乐视频制作应用TikTok,也就是抖音国际版。不久前,美国军队出于安全考虑,也明确规定了禁用TikTok。

根据印尼媒体的报道,印尼政府禁止TikTok是因为该应用程序包含了太多负面视频,印亚公众情绪也普遍反对青少年使用TikTok,因为有些视频会对青少年造成不良影响。其中一个视频是这样的:开始是一段舞蹈,随后镜头猛然切到一具尸体,有关部门调查后发现这具尸体是拍摄者的亲戚。

除了上述涉及死亡的视频,世界范围内对以下内容的视频都格外谨慎:

- 煽动暴力的宗教仇恨言论

- 假新闻和为政治目的而传播

- 针对个人/组织的诽谤性语言

除了涉及到“视频暴力”的内容外,对“视频色情”的界定同样具有高度的主观性和任意性。之前Instagram曾因允许“男性裸露乳头”但禁止“女性裸露乳头”,引起不少女性在该软件上进行抗议。

和Instagram相比,某些社交网站的规则显得“宽松”了许多,他们允许在某些特殊情况下的裸体行为。

以不久前更新了内容规则的Tumblr为例,从中可以看到一些有趣的说明:“被禁止的内容包括人类生殖器的照片和视频、女性展示乳头,以及任何涉及性行为的媒介,包括插图。例外情况包括裸体古典雕像和以裸体为特征的政治抗议行为。新的指导方针排除了文本,色情仍然是允许的。只要性行为没有被明显描绘 出来,以裸体为特征的插图和艺术仍然是允许的,母乳喂养和产后照片同理。”

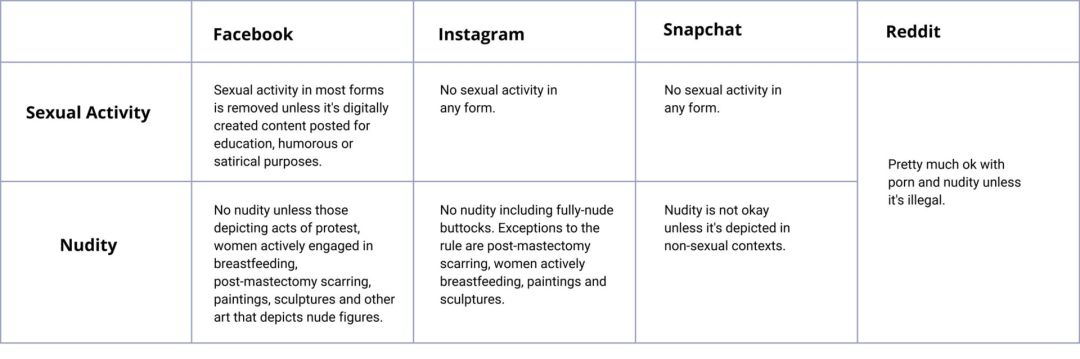

在这里也可以对比看一下Facebook、Reddit等在内的全球流量较大的四家社交平台关于“色情”和“裸露”的相关规则:

可以看出,基于不同的价值观、服务的用户群体和他们的文化敏感性,就必须为他们提供专属的规则和例外。也就是说,由于内容具有的主观性,想要一劳永逸地创建全球性的内容标准是非常困难是难以实现的。

在内容审核工作中,AI能干啥?

尽管有诸多限制和不足,但仍不妨碍AI审核已是大势所趋。

目前AI在内容审核方面除了能评估和检测垃圾邮件、辱骂留言等极端文本内容外,在某些社交平台上,AI还能拦截违规图像,甚至可以针对以情境理解为基础的骚扰和欺凌进行排查。

但是,在利用AI进行内容审核还要注意以下三个方面:

- 对内容的审核需要文化意识和对相关社区“标准”的语境理解。尽管AI可以执行预调节,帮助减少人工审核的工作量,但人工参与仍是不可缺少的环节。

- AI面临着公众不信任,特别是可能存在无意识的人类或技术偏见。此外,算法可能对违规内容起不到检测作用。针对此,一方面要定期分析并调整算法,另一方面,利益相关者应保证AI的透明度。

- 由于格式多样性和内容复杂度,用户生成的视频内容越来越难以分析,它们需要被解释为一个整体,以此来鉴定是否违规。为了更好地了解用户行为,及时更新违规有害内容的定义,平台和服务提供商之间最好能够共享数据集,这有利于利益相关者获得更好的文化意识和语境理解。

在理想情况下,如果AI能完全做到上述几点,就行了吗?

让我们再次回到内容审核上,当AI审核实现了最大程度地优化,更大幅度地提升了审核师的工作效率,审核师团队的心理问题似乎仍然悬而未决。

在采访过程中文摘菌也了解到,除了视频审核团队,为了设计出更加精确可用的审核算法,算法工程师们日常也需要观看大量的暴力色情视频,也因此不可避免的受到同样的影响。技术的进步尽管无人可挡,但被媒体和大众寄予厚望的AI,其成长也注定承载着个人牺牲。

作为技术洪流中的观看者,我们没有权利也没有能力去改变审核师或者算法工程师的工作,但至少我们可以给予这个群体更多的关注。就像Daisy所说:“我们需要更多的人参与到这项工作中,但我们更需要改变整个系统和工作结构,去支持这些人,为他们提供处理问题的工具和资源,否则问题只会变得更糟。”

相关报道:

https://www.theverge.com/2019/12/16/21021005/google-youtube-moderators-ptsd-accenture-violent-disturbing-content-interviews-video