Tech 导读 本文将深入探讨如何在百万级别的高并发场景下实现高效的数据检索和处理。重点关注倒排索引的实现机制,这是一种使搜索更加迅速的数据结构,以及位图计算,一种优化存储和提高检索效率的技术。通过实际案例分析可以了解这些技术如何帮助处理大规模数据集,保证响应速度,并在高负载环境下维持系统的稳定性。

01

背景

在今年的敏捷团队建设中,我通过Suite执行器实现了一键自动化单元测试。Juint除了Suite执行器还有哪些执行器呢?由此我的Runner探索之旅开始了!

Promise时效控单系统作为时效域的控制系统,在用户下单前、下单后等多个节点均提供服务,是用户下单黄金链路上的重要节点;控单系统主要逻辑是针对用户请求从规则库中找出符合条件的最优规则,并将该规则的时效控制结果返回客户端,比如因为临时疫情等原因针对仓、配、商家、客户四级地址等不同维度进行精细粒度的时效控制。

该系统也是Promise侧并发量最大的系统,双11高峰集群流量TPS在百万级别,对系统的性能要求非常高,SLA要求在5ms以内,因此对海量请求在规则库(几十万)中如何快速正确匹配规则是该系统的技术挑战点。

02

朴素的解决方案

理解,首先 MCube 会依据模板缓存状态判断是否需要网络获取最新模板,当获取到模板后进行模板加载,加载阶段会将产物转换为视图树的结构,转换完成后将通过表达式引擎解析表达式并取得正确的值,通过事件解析引擎解析用户自定义事件并完成事件的绑定,完成解析赋值以及事件绑定后进行视图的渲染,最终将目标页面展示到屏幕。

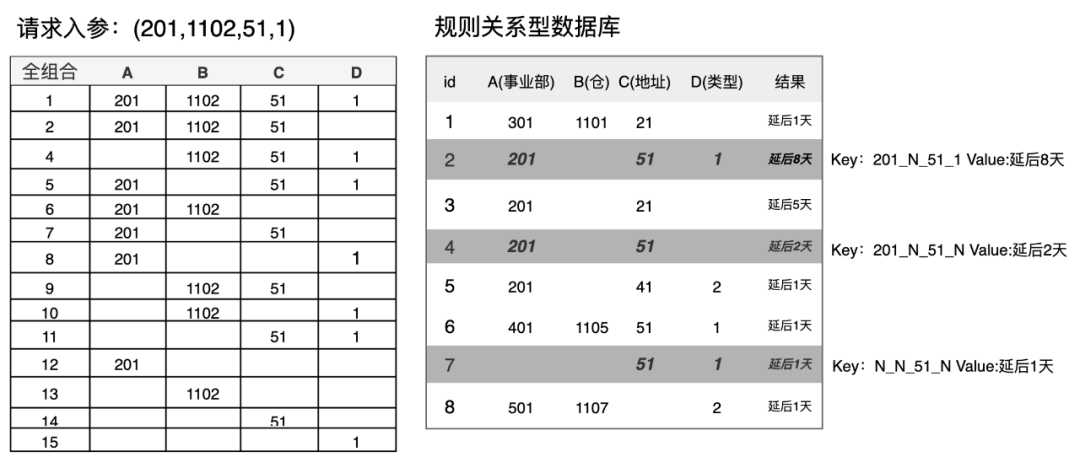

按照朴素的思想,在工程建设上,通过异步方式将规则库逐行缓存到Redis,Key为规则条件,Value为规则对应结果;当用户请求过来时,对请求Request(a,b,c,d..)中的参数做全组合,根据全组合出的Key尝试找出所有可能命中的规则,再从中筛选出最优的规则。如下图所示

图 1.

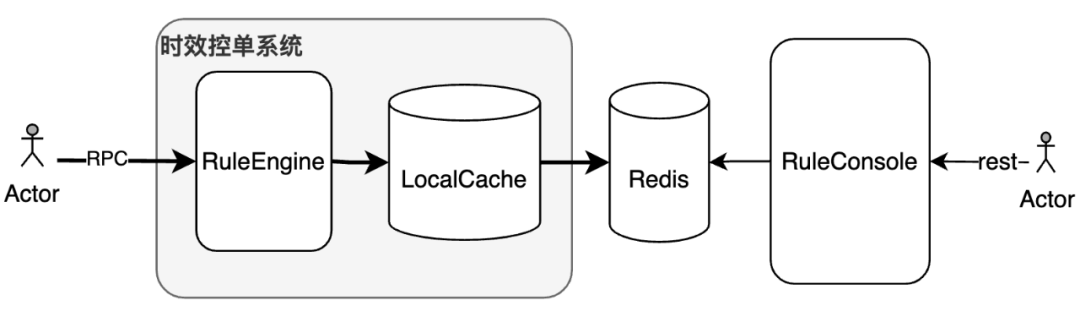

该方案面临的问题是全组合的时间复杂度是2**n,n≈12;算法的时间复杂度高且算法稳定性差,最差情况一次请求需要4096次计算和读取操作。当然在工程上可以使用本地缓存做一些优化,但是无法解决最根本的性能问题。架构简图如下所示:

图 2.

03

新的解决方案

理解,首先 MCube 会依据模板缓存状态判断是否需要网络获取最新模板,当获取到模板后进行模板加载,加载阶段会将产物转换为视图树的结构,转换完成后将通过表达式引擎解析表达式并取得正确的值,通过事件解析引擎解析用户自定义事件并完成事件的绑定,完成解析赋值以及事件绑定后进行视图的渲染,最终将目标页面展示到屏幕。

上面方案是从行的角度看待匹配定位的,能够命中的行的每一列必然也是符合条件的,这里面存在某种隐约的内在联系。能否反过来思考这个问题,为此本文尝试进行新的方案,当然架构简图依然如上图所示,核心优化的是命中算法。

新的方案整体采用列的倒排索引和倒排索引位运算的方式,使得计算复杂度由原来的2**n降至n,且算法稳定性有非常好的保证。其中列的倒排索引是对每列的值和所分布的行ID(即Posting List)建立KV关系,倒排索引位运算是对符合条件的列倒排索引进行列间的位运算,即通过联合查询以便快速找到符合条件的规则行。

04

算法详细设计

理解,首先 MCube 会依据模板缓存状态判断是否需要网络获取最新模板,当获取到模板后进行模板加载,加载阶段会将产物转换为视图树的结构,转换完成后将通过表达式引擎解析表达式并取得正确的值,通过事件解析引擎解析用户自定义事件并完成事件的绑定,完成解析赋值以及事件绑定后进行视图的渲染,最终将目标页面展示到屏幕。

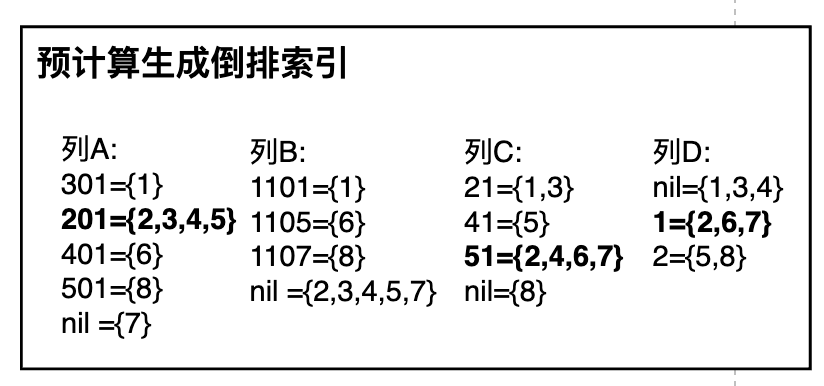

4.1 预计算生成列的倒排索引和位图

通过对每列的值进行分组合并生成Posting List,建立列值和Posting List的KV关系。以下图为例,列A可生成的倒排索引为:301={1},201={2,3,4,5}等,需要说明的一点,空值也是一种候选项,也需要生成KV关系,如nil={7}。

图 3.

4.2 生成列的倒排索引对应位图

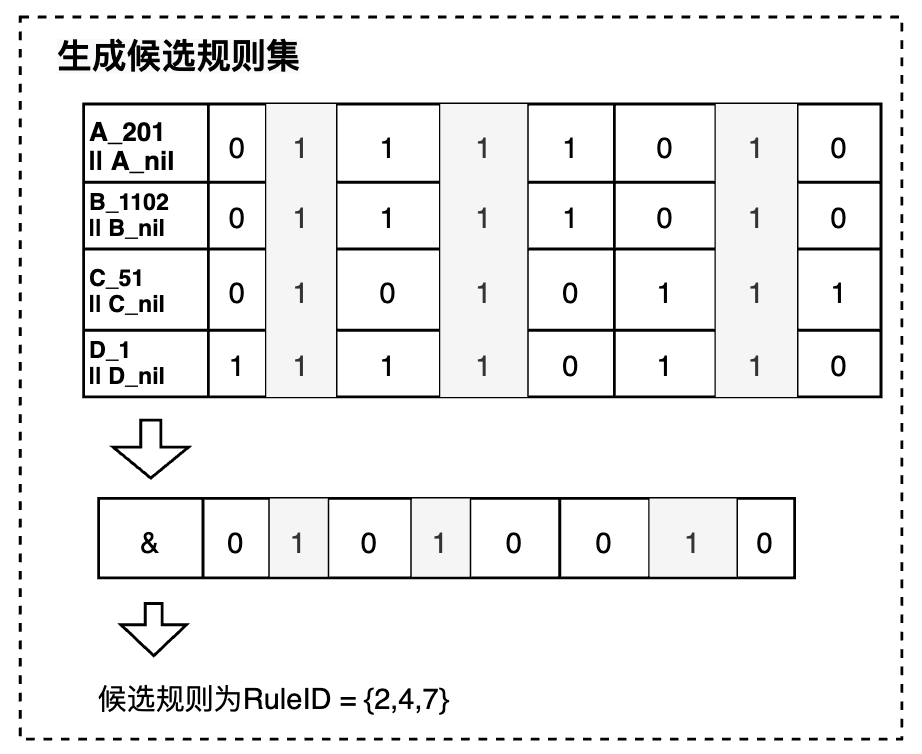

将用户请求中的入参作为Key,查找符合条件的位图,对每一列进行列内和空值做||运算,最后列间位图做&运算,得到的结果是候选规则集,如下图所示:

图 4.

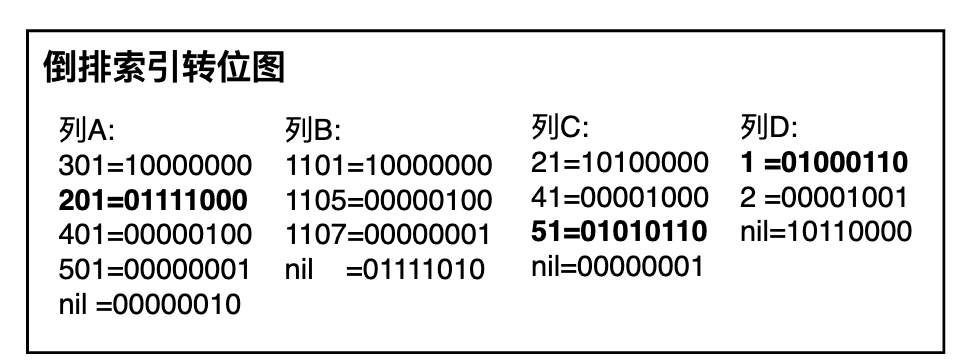

4.3 根据用户请求查找列位图,通过位图计算生成候选规则集

将用户请求中的入参作为Key,查找符合条件的位图,对每一列进行列内和空值做||运算,最后列间位图做&运算,得到的结果是候选规则集,如下图所示:

图 5.

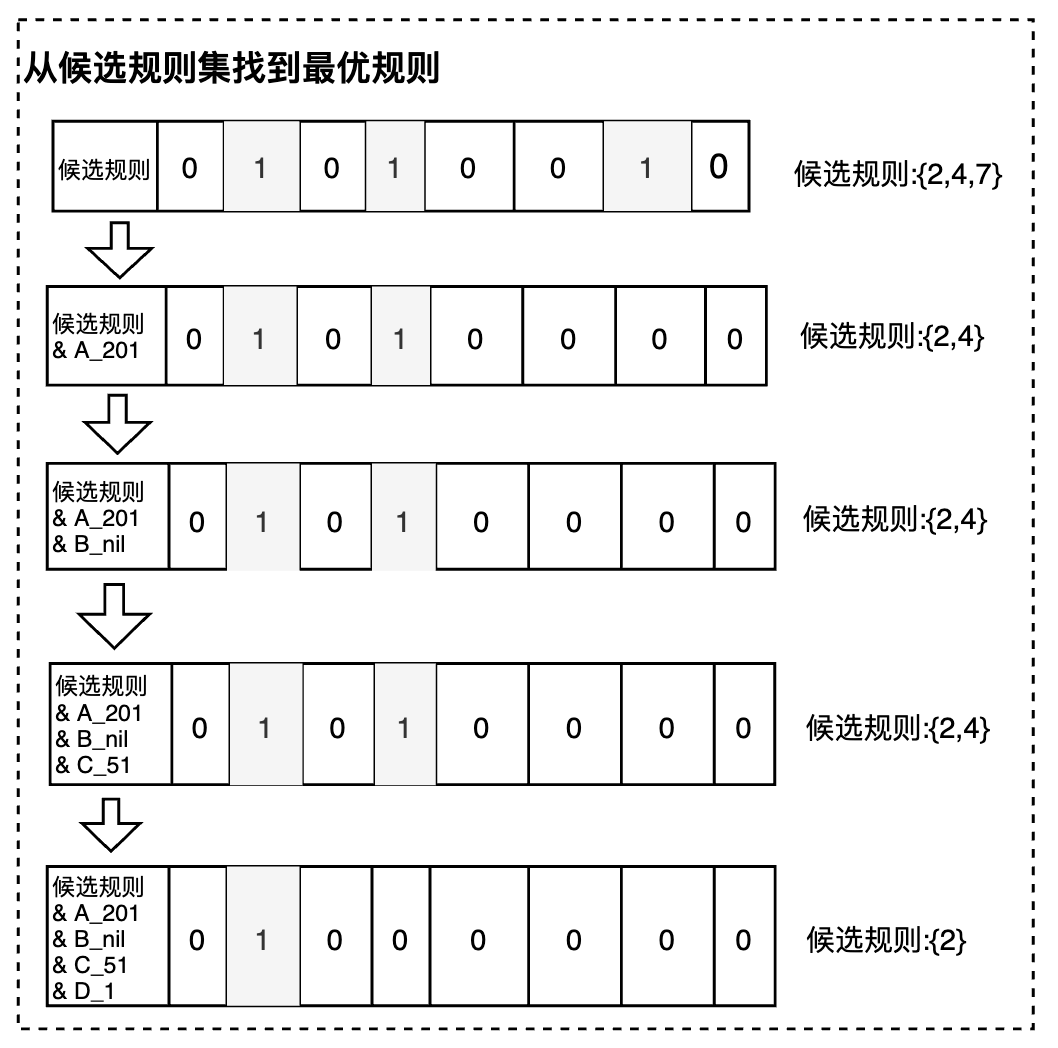

4.4 从候选规则库中,根据业务优先级排序,查找最优的规则

以候选规则为基点,按照业务优先级排序,进行逐级位运算&,当遍历完或位运算为0时,找到最后不为空的即为最优规则,该过程是从候选规则库逐渐缩小最优范围的过程。需要说明某列当用户请求位图不存在时,需要使用对应的空位图进行参与,以B列为例,入参B_1102不存在,需要使用B_nil参与&。

图 6.

05

复杂度分析

理解,首先 MCube 会依据模板缓存状态判断是否需要网络获取最新模板,当获取到模板后进行模板加载,加载阶段会将产物转换为视图树的结构,转换完成后将通过表达式引擎解析表达式并取得正确的值,通过事件解析引擎解析用户自定义事件并完成事件的绑定,完成解析赋值以及事件绑定后进行视图的渲染,最终将目标页面展示到屏幕。

通过上面的例子可以看到,在时间复杂度方面查找候选规则集时,进行一轮||运算,一轮&运算;在查找最优规则时进行一轮&运算,所以整体复杂度是3n≈n。

在空间复杂度方面,相比原来的行式存储,倒排索引的存储方式,每列都需要存储行ID,相当于多了(n-1)*Posting List存储空间,当然这是粗略计算,因为实际上行ID的存储最终转换为位图存储,在空间上有非常大的压缩空间。

06

工程问题—压缩位图

理解,首先 MCube 会依据模板缓存状态判断是否需要网络获取最新模板,当获取到模板后进行模板加载,加载阶段会将产物转换为视图树的结构,转换完成后将通过表达式引擎解析表达式并取得正确的值,通过事件解析引擎解析用户自定义事件并完成事件的绑定,完成解析赋值以及事件绑定后进行视图的渲染,最终将目标页面展示到屏幕。

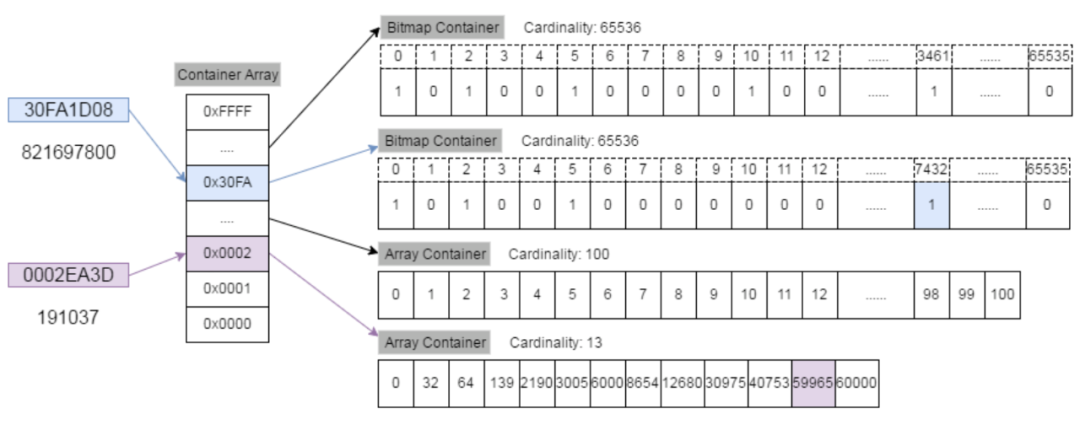

如果倒排索引位图非常稀疏,系统会存在非常大的空间浪费。举一个极端case,若千万规则库中命中的行ID是第1000万位,按照传统方式BitSet进行存储,需要消耗1.2MB空间,在内存中占用存在严重浪费,有没有压缩优化方案,在RoaringBitMap压缩位图方案中我们找到,相同场景在压缩位图方式下仅占144bytes;即使在1000万的位图空间,随机存储1万个值,两者比也是在31K vs 2MB,近100倍的差距,总的来说RoaringBitMap压缩率非常大。

RoaringBitMap本质上是将大块的bitmap拆分成各个小块,其中每个小块在需要存储数据的时候才会存在,所以当进行交集或并集运算的时候,RoaringBitMap只需要去计算存在的块而不需要像bitmap那样对整个大块进行计算,既做到了压缩的存储又做到计算性能的提升。

以下图821697800为例,对应的16进制数为30FA1D08,其中高16 位为30FA,低16位为1D08。先用二分查找从一级索引(即Container Array)中找到数值为 30FA 的容器,该容器是一个Bitmap容器,然后在该容器查找低16位的数值1D08,即十进制下7432,在Bitmap中找到相应的位置,将其置为1即可。

图 7.

07

适用场景分析

理解,首先 MCube 会依据模板缓存状态判断是否需要网络获取最新模板,当获取到模板后进行模板加载,加载阶段会将产物转换为视图树的结构,转换完成后将通过表达式引擎解析表达式并取得正确的值,通过事件解析引擎解析用户自定义事件并完成事件的绑定,完成解析赋值以及事件绑定后进行视图的渲染,最终将目标页面展示到屏幕。

回顾上面的设计方案可以看到,这种方式仅适用于PostingList简单如行ID的形式,如果是复杂对象就不适合用位图来存储。另外仅适用于等值查询,不适用于like、in的范围查询,为什么有这种局限性?因为这种方式依赖于搜索条件的空间,在方案中将值的条件作为搜索的Key,值的条件空间希望尽可能是一个有限的、方便穷举的、小的空间。而范围查询导致这个空间变成难以穷举、近乎无限扩张的、所以不适用。

08

其他优化方式

理解,首先 MCube 会依据模板缓存状态判断是否需要网络获取最新模板,当获取到模板后进行模板加载,加载阶段会将产物转换为视图树的结构,转换完成后将通过表达式引擎解析表达式并取得正确的值,通过事件解析引擎解析用户自定义事件并完成事件的绑定,完成解析赋值以及事件绑定后进行视图的渲染,最终将目标页面展示到屏幕。

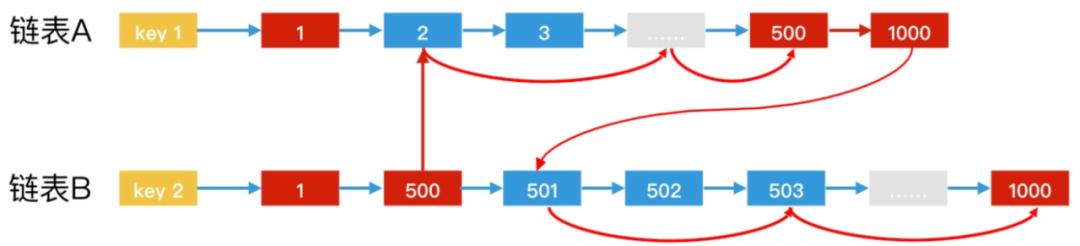

除了使用位运算的方式对倒排索引加速,考虑到Posting List的有序性,还有其他的方式比如使用跳表、Hash表等方式,以ES中采用的跳表为例,进行&运算实际就是在查找两个有序Posting List公共部分,以相互二分查找的形式,将时间复杂度控制在log(n)的级别。

图 8.