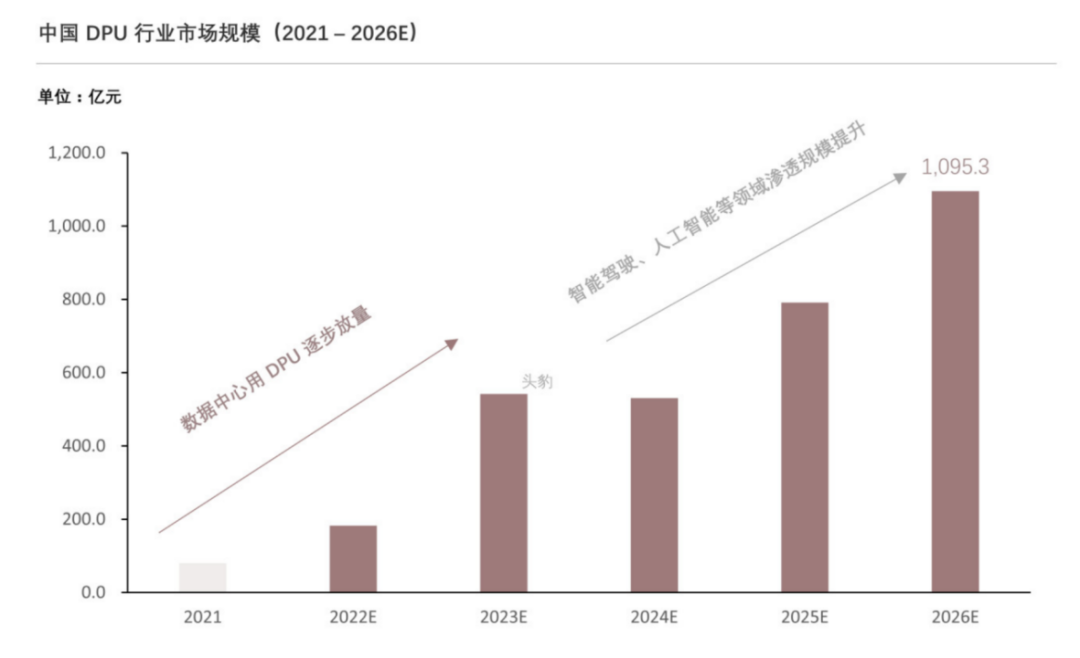

DPU是以数据处理为中心的芯片,2020年NVIDIA战略中国将其称为CPU、GPU之后“第三颗主力芯片”,认为“它将成为未来计算的三大支柱之一”。头豹研究院预测,数据中心领域DPU即将放量,随智能驾驶、元宇宙等其他领域的需求被不断挖掘,DPU渗透应用领域将持续扩大,中国 DPU市场规模将有望于2026年达到1095.3亿元。

DPU市场的火热引得国内外大厂纷纷入局,也催生出了一批批创业公司。那么目前主要有哪些DPU玩家呢?

国外厂商

Nvidia

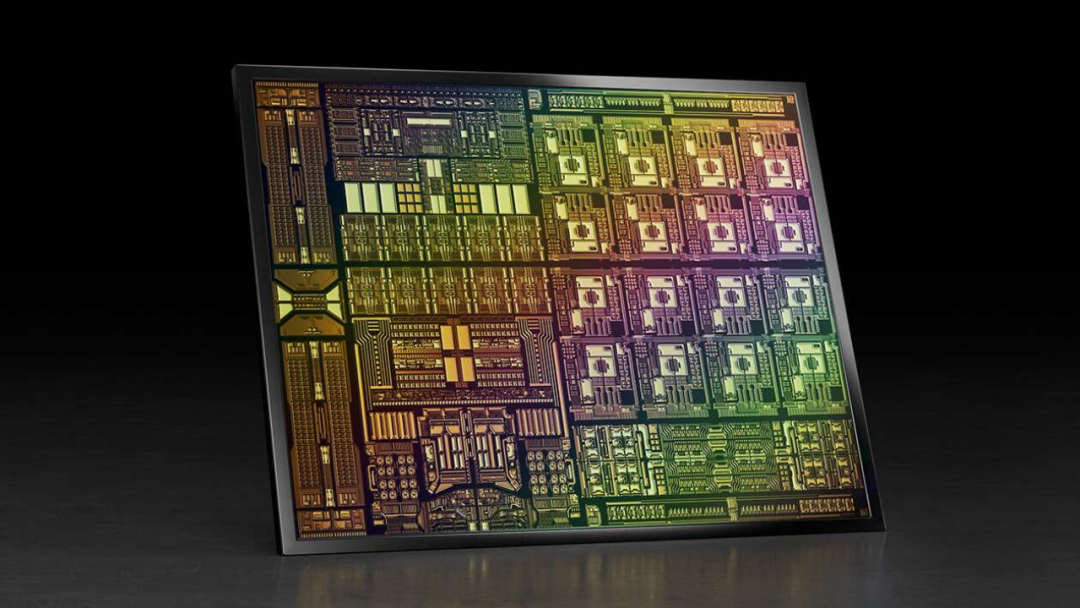

Nvidia创立于1993年,总部位于美国加利福尼亚州圣克拉拉市。1999年,Nvidia定义了GPU,极大地推动了PC游戏市场的发展,重新定义了现代计算机图形技术。2020年4月,NVIDIA官方宣布已完成对Mellanox的收购,产品布局覆盖CPU、GPU和DPU。

NVIDIA BlueField DPU为现代数据中心带来了创新。通过对各种高级网络、存储和安全业务进行卸载、加速和隔离,BlueField DPU 可为云、数据中心或边缘计算等环境中的各种工作负载提供安全加速的基础设施。BlueField DPU 将强大的计算能力、完整的片上基础设施可编程性及高性能网络相结合,支撑要求严苛的工作负载。

- 从边缘到中心的安全性:BlueField DPU 支持零信任的全方位安全架构,覆盖数据中心及边缘计算。

- 为不断扩展的工作负载提供弹性存储:借助 NVMe over Fabric (NVMe-oF)、GPUDirect 存储、加密、弹性存储、数据完整性、解压缩和重复数据删除的支持,BlueField 可提供高性能存储访问方案,为远程存储实现媲美直连式存储的超低延迟。

- 高性能且高效的网络:BlueField 是一款强大的数据中心服务加速器,可为传统应用和现代 GPU 加速的应用提供高达 400 Gb/s 的以太网或 InfiniBand 连接速度,同时释放主机 CPU 内核,以运行基础设施任务之外的应用。

- 软件定义的基础设施:NVIDIA DOCA™ 软件开发套件 (SDK) 使开发人员能够利用行业标准 API 轻松创建高性能、软件定义、云原生的 DPU 加速服务。

NVIDIA BlueField-3 是首款以线速处理软件定义网络、存储和网络安全的 400Gb/s DPU。BlueField-3 将强大的计算能力、高速网络和广泛的可编程性相结合,为要求苛刻的工作负载提供软件定义的硬件加速解决方案。从加速 AI 计算,到混合云,再到云原生超级计算和 5G 无线网络,BlueField-3 重新定义了各种可能性。

官网:https://www.nvidia.com/en-us/

AMD

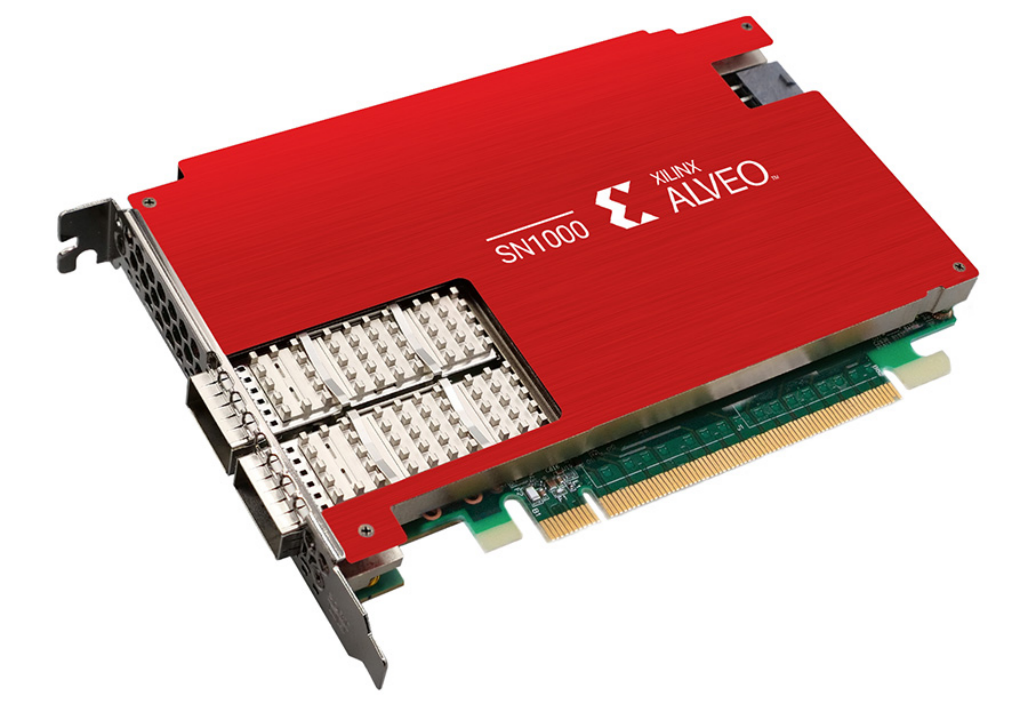

AMD半导体公司成立于1969年,专门为计算机、通信和消费电子行业设计和制造各种CPU、GPU等微处理器。2022年2月,AMD终于完成了对Xilinx的收购,这笔价值接近500亿的交易为AMD带来了Xilinx的FPGA可编程逻辑模块和相关的DSP引擎、AI加速器、内存控制器等关键技术,为AMD补齐了技术储备。

Xilinx提供的DPU/SmartNIC是 Alveo 系列,Alveo 系列基于 FPGA,能够加速计算密集型应用程序,包括机器学习推理、数据分析、视频转码和许多其他工作负载,Alveo 系列的性能比 CPU 的性能高90倍,并且能够根据用户的具体要求对其进行重新编程,由于算法比芯片设计周期发展得更快,因此需要能够适应不断变化的算法的可编程硬件。

Xilinx Alveo SN1000 是业界首款为单个平台中的所有功能卸载提供软件定义硬件加速的 SmartNIC。SN1000 SmartNIC 直接卸载 CPU 密集型任务以优化网络性能,其架构可以以线速加速各种自定义卸载,包括支持客户构建和第三方卸载。SN1000 SmartNIC 基于 Xilinx 16nm UltraScale+™ 架构,由低延迟 Xilinx XCU26 FPGA 和 16 核 Arm® 处理器提供支持。

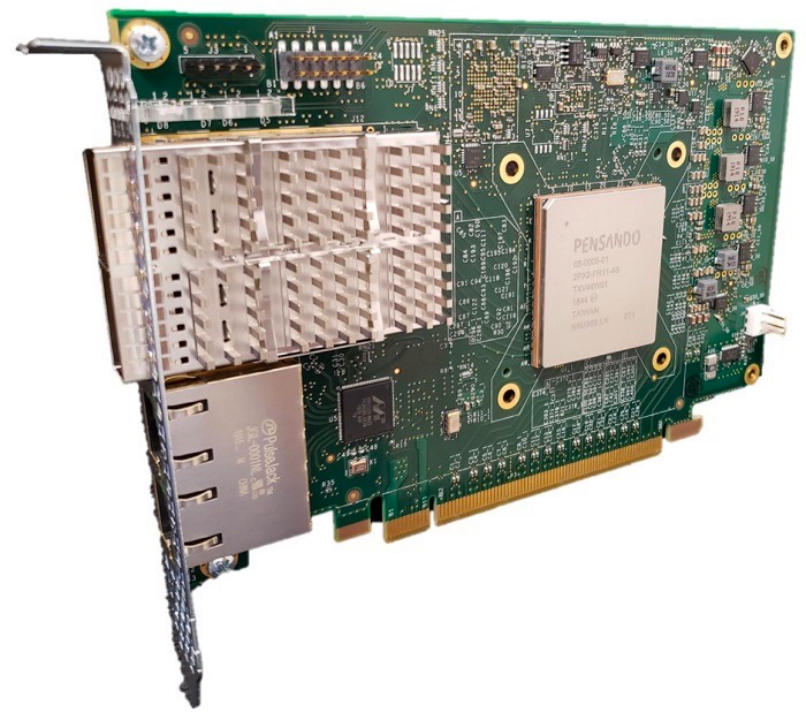

2022年5月,AMD 宣布完成对 Pensando Systems 的收购,交易价格约为 19 亿美元。Pensando 的分布式服务平台,将通过高性能数据处理单元(DPU)和软件堆栈扩展 AMD 的数据中心产品组合。这些产品已在高盛、IBM Cloud、Microsoft Azure 和 Oracle Cloud 等云和企业客户中大规模部署。Pensando 的 Elba SoC 是一款专注于智能网络交换机的DPU,上一款 Capri DPU被用于 Aruba CX 10000 。

官网:https://www.amd.com/en

Intel

在“Intel Vision 2022”,大会上Intel公布了其最新的IPU路线图,展示了从2022年至2026年IPU的整体规划。英特尔将继续 ASIC + FPGA IPU 设计,其IPU路线图如下:

- 2022年:推出了200 Gbps IPU,代号为Mount Evans和Oak Springs Canyon。

- 2023/2024年:推出 400 Gbps IPU,代号为Mount Morgan和Hot Springs Canyon。

- 2025/2026 : 推出800 Gbps IPU。

Mount Evans是Intel首个ASIC IPU,与Google Cloud合作开发,针对高端和超大规模数据中心服务器。Oak Springs Canyon是Intel第二代基于 FPGA 的 IPU 平台,该平台采用Intel Xeon-D和Agilex FPGA 构建。

Intel IPU 技术的关键之一是所有设备都支持的快速可编程数据包处理引擎。无论是 FPGA 还是基于 ASIC 的产品,客户都可以使用P4 对其进行编程,并支持查找、更改、加密和压缩等流程。

另外,Intel还推出了IPU的开源开发工具包IPDK ,它可以用于为x86芯片和Arm芯片(如Marvell的Octeon)编写应用程序。该工具包包括用于自定义和定义工作负载的功能块,其中包括卸载包处理。(更多可点击:IPDK:可编程基础设施时代的开源开发框架)

官网:https://www.intel.com/

Marvell

Marvell成立于1995年,总部在硅谷,在中国上海设有研发中心,是一家提供全套宽带通信和存储解决方案的全球领先半导体厂商。

Marvell的OCTEON和ARMADA设备设计用于无线基础设施和网络设备,包括交换机、路由器、安全网关、防火墙、网络监控和智能网卡(SmartNIC),并支持全面统一的SDK和开源API,用于广泛的网络、安全和计算市场应用。

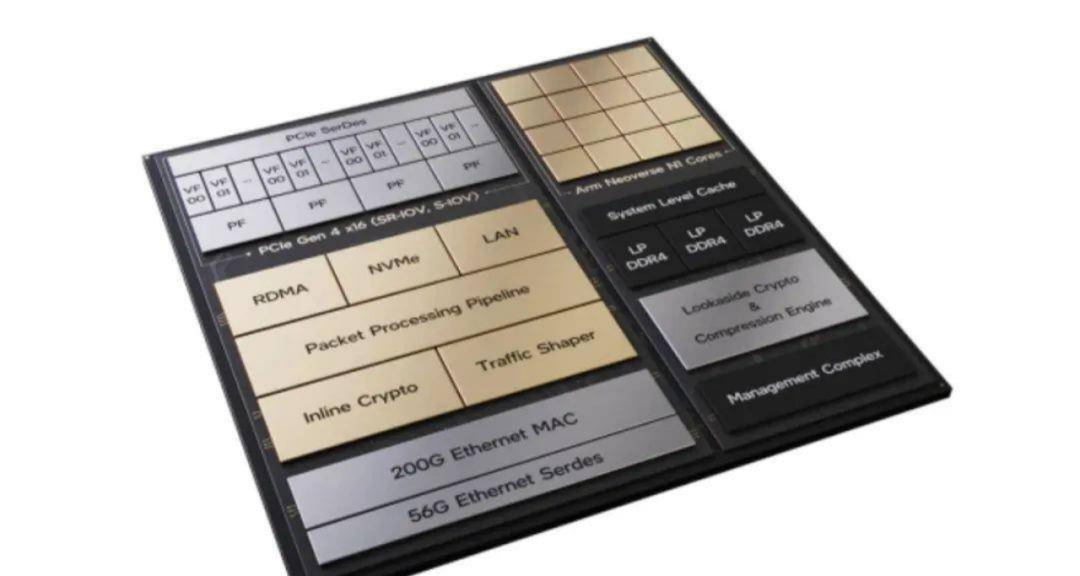

Marvell 的 OCTEON 10 DPU 系列针对超大规模云工作负载、5G 无线传输、5G RAN 智能控制器 (RIC) 和边缘推理、运营商和企业数据中心应用以及无风扇网络边缘盒进行了优化。OCTEON 10采用台积电5nm制程工艺和ARM的Neoverse N2 CPU内核,外加上一代OCTEON TX2的众多功能构建块阵列,同时还包括集成机器学习推理的引擎、内联加密处理器以及矢量数据包处理器等先进的IP以及功能,而且都能够以虚拟化方式运行。作为DPU的重要补充,Marvell还为OCTEON 10引入内部机器学习(ML)引擎。

- 业界首款采用 Arm Neoverse N2 内核的 5nm DPU,与前几代 OCTEON 相比,计算性能提高 3 倍,功耗降低 50%

- 用于内联 ML/AI 的创新硬件加速器提供比基于软件的推理 100 倍的性能提升

- 基于 VPP 的硬件加速器将数据包处理速度提高了 5 倍以上

- 集成 1 Terabit 交换机、真正的内联加密和高度可编程的数据包处理

- 数据路径支持超过 400G

- 支持最新的PCIe 5.0 I/O与DDR5内存

官网:https://www.marvell.com/

Broadcom

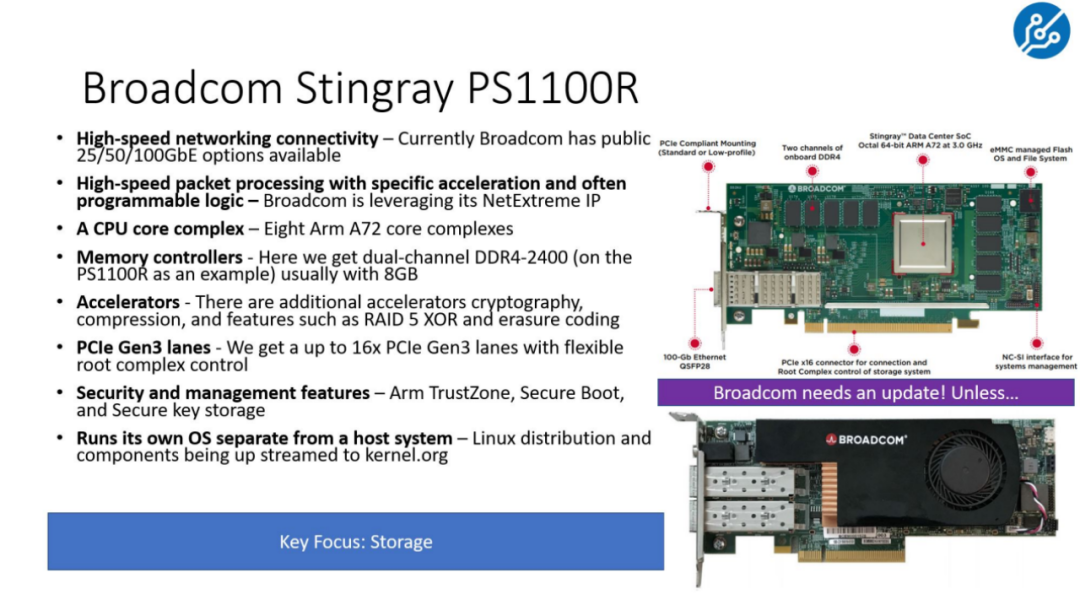

Broadcom的Stingray 结合了强大的网络控制器、高性能 ARM CPU、PCI Express 3.0、性能加速器和 DDR4 RAM,将计算密集型应用程序从主机服务器的 CPU 卸载。

Stingray 能够提供高数据包速率和低延迟。Broadcom以NetXtreme E系列控制器的逻辑为基础,在Stingray的核心部分设计了NetXtreme-S BCM58800芯片,然后在集群配置中放置了8个主频为3 GHz的Arm v8 A72内核。此外,Stingray还可以配置16 GB DDR4内存。

Broadcom还采用了TruFlow技术,这是一个可配置的流加速器,用于将常见的网络流过程转移到硬件中。从已发布的数据来看,TruFlow可以在硬件上卸载诸如Open vSwitch(OvS)之类的任务。该公司还声称TruFlow在硬件中实现了许多经典的SDN概念,比如分类、匹配和操作。因此,Stingray配备了两个可编程组件,即TruFlow和由四个3 GHz双核Arm v8 A72复合体组成的集群。

官网:https://www.broadcom.com/

Fungible

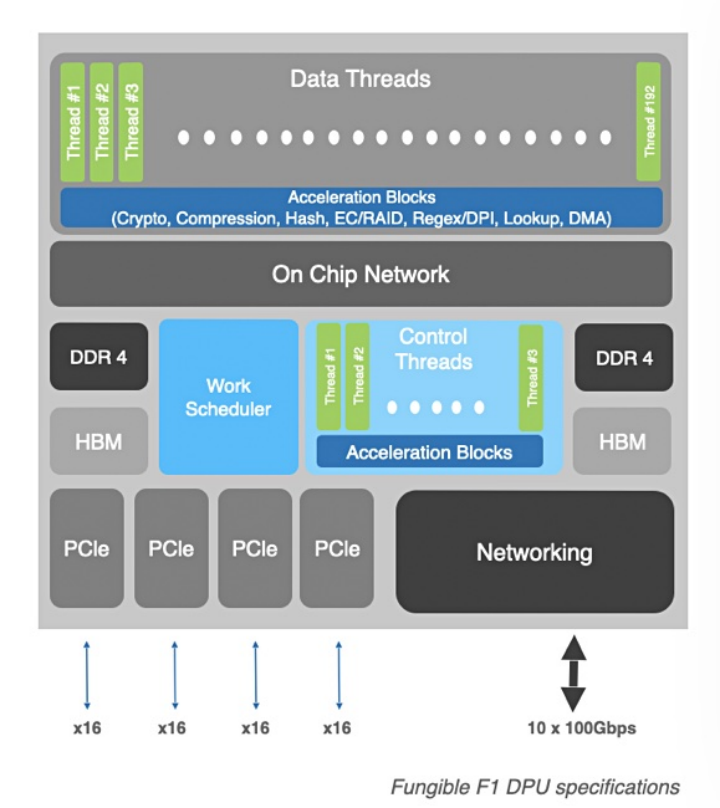

2019年,Fungible将DPU定义为一种新型数据处理单元。Fungible的F1 DPU是业内第一个800Gbps的DPU,也是Fungible DPU系列的旗舰产品。

在架构上,F1 DPU集成了大量的多核处理器,52个核心均为最新一代的MIPS64 R6内核,不仅支持硬件虚拟化也将其分为独立的控制单元。F1 DPU采用了双发射流水线设计,配有64KB的L1 I-cache和80KB的L1 D-Cache,且L1缓存支持缓存之间的数据传输,总计片上L2缓存达到32MB。内存方面,F1 DPU除了集成8GB的HBM外,还支持双通道每通道最高512GB的DDR4内存。

利用了独特的硬件与软件结合设计,在不影响数据中心计算能效的前提下,F1 DPU提供了最大的功能灵活性。这使得F1 DPU可以用于高性能密度和低时延的环境,比如存储(NVMe/TCP存储卸载)、安全、AI/ML(GPU解耦)和数据分析服务器(OLAP、OLTP大数据分析引擎)。以存储为例,在无需x86 CPU和AFA的存储系统中,F1 DPU可以做到15M IOPS的表现,而这里的带宽限制完全是来自于PCIe本身的带宽限制。

官网:https://www.fungible.com/

AWS

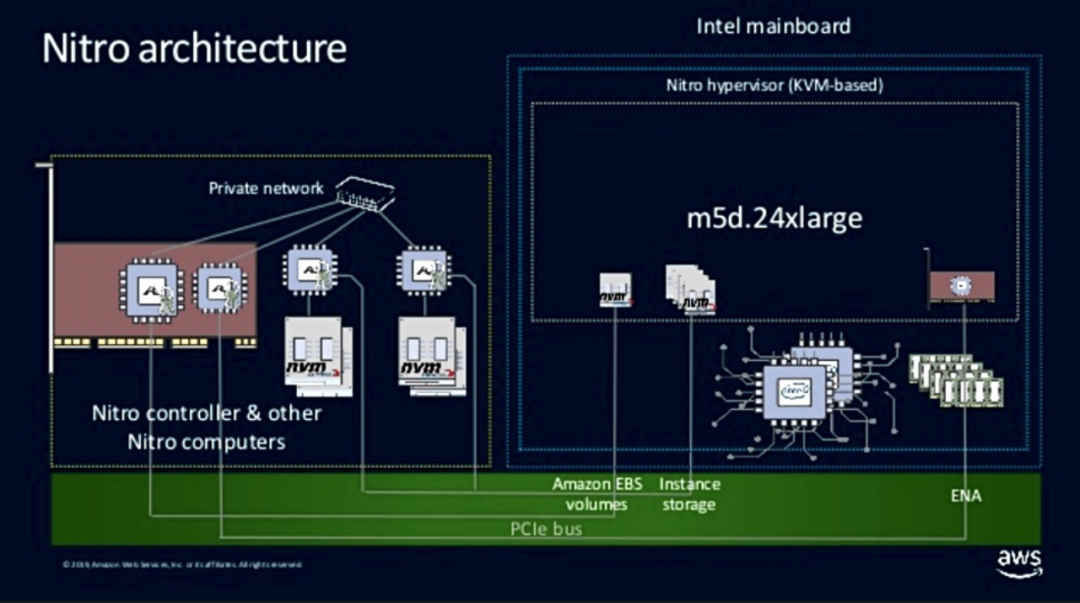

追溯DPU的源头,真正实现大规模商用DPU架构的主要有两家云计算巨头:Amazon AWS和阿里云。Amazon Nitro系统从 2013 年开始研发,2017 年正式发布,旨在最大化性能和安全。

AWS Nitro产品家族旨在将数据中心开销(为虚拟机提供远程资源、加密解密、故障跟踪、安全策略等服务程序)全部从CPU卸载到Nitro加速卡上,将给上层应用释放30%的原本用于支付“Tax” 的算力。

Nitro系统主要由三部分组成:

- 以PCIe卡形式呈现的Nitro卡,主要包括支持网络功能的VPC(Virtual Private Cloud)卡,支持存储功能的EBS(Elastic Block Store)、Instance Storage卡和支持系统控制的Nitro Controller卡。

- Nitro安全芯片,该芯片提供Hardware Root of Trust,防止运行于通用服务器上的软件对non-volatile storage进行修改,比如虚拟机的UEFI程序。

- 运行于通用服务器的Nitro Hypervisor,这是个基于kvm的轻量级hypervisor,主要提供CPU和内存的管理功能,不提供设备的模拟(因为所有的设备都是通过透传的方式添加到虚拟机中)。

官网:https://aws.amazon.com/cn/

国内厂商

阿里云

阿里云于2017年10月推出的神龙架构被业界视作迄今最成功的DPU之一。如今,第四代阿里云神龙已经开始支撑阿里云的大规模云上业务。

2022年阿里云峰会上,阿里云发布了一款云数据中心专用处理器CIPU(Cloud infrastructure Processing Units),号称将替代CPU成为云时代IDC的处理核心。CIPU相对轻量级,不是通用计算类芯片,而是专用于云计算数据中心的管控,可以综合调度CPU、GPU、存储硬盘、交换机等硬件。

阿里云的CIPU和亚马逊AWS的Nitro定位类似。它既是硬件盒子,也是管控系统,对接飞天云操作系统。CIPU主要由专用芯片和控制器构成,形态像盒子或智能网卡,主要用于管理飞天云操作系统。

- CIPU向下接入物理的计算、存储、网络资源,快速云化并进行硬件加速;向上接入飞天云操作系统,管控阿里云全球上百万台服务器:

- CIPU与计算结合:快速接入不同类型资源的服务器,带来算力的“0”损耗,以及硬件级安全的加固隔离;

- CIPU与存储结合:对存算分离架构的块存储接入进行硬件加速,云盘存储IOPS最高可达300万,长尾时延降低50%;

- CIPU与网络结合:可对高带宽物理网络进行硬件加速,构建大规模弹性RDMA高性能网络,时延最低可达5us。

官网:https://www.aliyun.com/

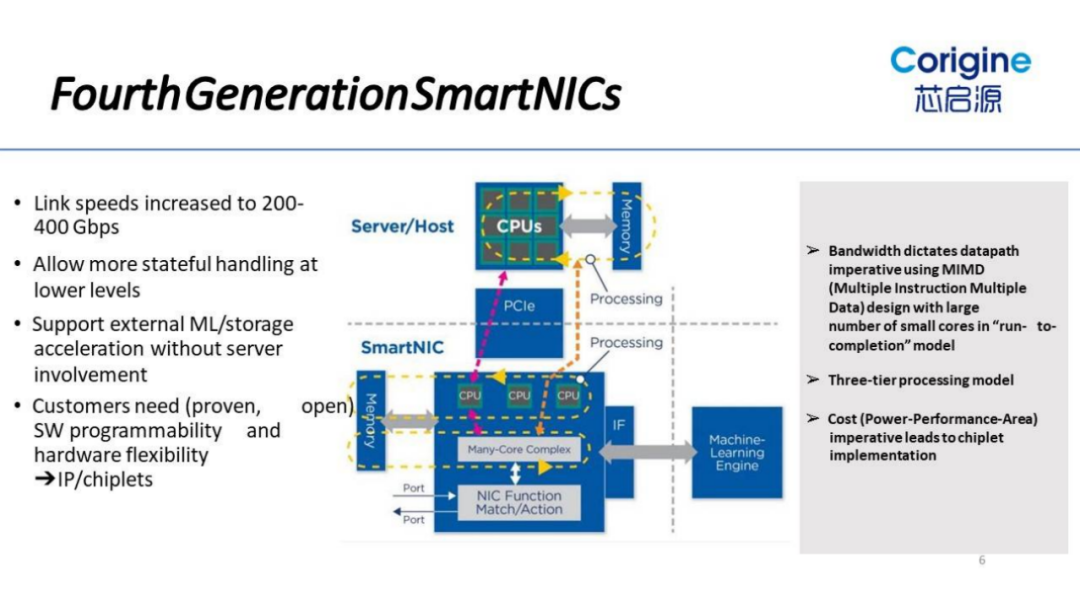

芯启源

芯启源成立于2015年,聚焦网络通讯、5G和云数据中心等众多先进领域,客户包括且不限于运营商及二级运营商、路由器交换机设备商、OTT及互联网厂商、网络安全厂商、5G/6G设备商等。

芯启源具有完全自主知识产权的DPU芯片。芯启源DPU较传统智能网卡提供了更大的处理能力、更强的灵活性、可编程数据包处理、可扩展Chiplet(小芯片)结构等特性。采用NP-SoC模式进行芯片设计,通用ARM架构结合高度优化面向数据包的NP芯片(RISC-V内核)、多线程的处理模式,使其可以达到ASIC固化芯片的数据处理能力,同时考虑到了全量可编程、灵活可扩展的属性,用以支持400Gbps及以上的性能目标、低功率且具有成本效益等。

芯启源DPU架构中采用的Chiplet(小芯片)技术是一种全新的芯片设计方式,也是业内众多企业正在引入的关键芯片技术。Chiplet将满足特定功能的Die(裸片)通过Die-To-Die内部互联技术实现多个模块芯片与底层基础芯片封装在一起,形成一个系统芯片。Chiplet技术将原本一块复杂的SoC芯片分解为芯粒,类似模块化设计,有利于缩短产品商用时间和后续产品的迭代,同时通过支持与第三方芯片的Die-To-Die互联,还可以集成更多的特定专业领域的芯片。在性能和功能丰富度有飞跃式提升外,也为芯启源的客户提供更多业务场景的支持能力。

官网:

https://www.corigine.com.cn/cn/index.html

益思芯

益思芯科技成立于2020年7月,团队由国内外网络、交换、存储领域的核心专业人员组成,在网络、交换、存储及高性能CPU等领域具有深厚的技术实力。

Stargate DPU智能网卡是国内第一款商用、具有自主知识产权的P4可编程云原生智能网卡,益思芯科技的P4网络加速引擎是全球首款针对vSwitch加速而设计的VLIW ISA P4处理器,支持千万级流表的同时性能可以做到数据包线速转发。该网卡是OVS、NFV、SDN vRouter、5G UPF等网络应用加速的最佳选择,具备高性能、低延迟、高灵活性、低功耗等特点:

- 高性能:在网卡上,单个P4引擎可以实现网卡全双工吞吐速率。l

- 低延迟:采用了指令级别并行处理架构,报文处理延迟可控制在纳秒级别。l

- 高灵活性:全面兼容P4-16版本,满足灵活的协议处理和系统平滑升级需求。l

- 低功耗:作为领域专用架构(Domain-specific Architecture),针对vSwitch加速而设计。在相同性能指标下,预估功耗只为传统NP架构和多核CPU架构的1/10。

官网:http://www.resnics.com/

云脉芯联

云脉芯联创立于2021年5月,是一家专注于云数据中心网络芯片产品研发与技术创新的高科技创新企业。

2022年5月31日,云脉芯联正式发布自主研发的国内首款多场景RDMA智能网卡(DPU)产品——xFusion50。2023上半年,云脉芯联将发布下一代高性能DPU芯片。xFusion50是云脉芯联成功自主研发的第一款产品,也是国内首款实现包括支持端到端拥塞控制完整RDMA功能的DPU产品,xFusion50基于硬件实现的可编程拥塞控制算法能够有效避免网络拥塞,充分发挥RDMA技术的低延迟和高性能,支持云计算、高性能计算、AI、存储集群全场景部署。xFusion50产品具有以下核心亮点:

- 支持可编程拥塞控制算法,可编程拥塞控制算法是实现端到端无损网络的关键技术;还可以通过开放可编程的底层网络接口,可根据客户的组网特点和上层业务的需求,灵活支持多种拥塞控制算法,最大化业务的流量吞吐。

- 通过自主研发HyperDirect技术支持GPU Direct RDMA 为跨计算节点的GPU实现远程内存直接访问,跳过CPU以降低时延、提升带宽,提升分布式异构算力集群的整体效能。

- 支持网络/存储全场景卸载加速,支持vSwitch全卸载,实现云上VPC网络全功能;支持存储卸载,对接分布式存储NVMe-oF(TCP/RDMA),充分释放宿主机CPU资源。并通过支持VirtIO实现弹性网络和弹性存储,满足云上用户无缝迁移和快速恢复的业务诉求。

官网:https://www.yunsilicon.com/

中科驭数

中科驭数成立于2018年,聚焦专用数据处理器的研发设计,基于自研敏捷异构KPU芯片架构以及DPU软件开发平台HADOS,公司自主研发了业界首颗融合高性能网络与数据库一体化加速功能的DPU芯片和标准加速卡系列产品,可广泛应用于超低延迟网络、大数据处理、5G边缘计算、高速存储等场景,助力算力成为数字时代的新生产力。

在DPU产品的研发迭代方面,中科驭数于2019年流片了第一代DPU芯片K1,第二代DPU芯片K2也于2022年初成功投片,目前已开始第三代DPU芯片K2 Pro的研发工作;2021年9月,中科驭数首发DPU加速卡产品,其时延达到业界领先的1.2微秒。另外也有DPU存储加速卡、DPU数据计算加速卡等产品和解决方案在研发进程中。在产品核心技术特色方面,中科驭数的DPU芯片创新性地采用软件定义加速器技术路线,实现了软硬协同的DPU设计方案。具体创新点如下:

- 高效的异构众核DPU架构,基于软件定义加速器路线,研发了异构众核DPU芯片设计方法,解决了多核互联、计算调度、指令控制等核心问题。

- 超高带宽网络协议处理,研发专用网络协议处理核和大数据分析处理核,解决了软件解析网络包协议解析和数据处理的瓶颈,大大提升服务器间通信效率,提升数据中心水平扩展能力。

- 统一的虚拟化硬件平台,针对数据中心网络、计算、存储融合的虚拟化需求,研究统一高效的硬件设备虚拟化架构,解决现有方案单一虚拟化功能的窘境(仅支持网络虚拟化),充分释放DPU各类资源能力,更高效支撑复杂上层应用。

- 统一的DPU软件开发框架HADOS,解决现有编程框架碎片化的问题,使得应用部署更加简单高效。

官网:

https://www.yusur.tech/zkls/zkys/index.html

大禹智芯

大禹智芯成立于2020年,其创始及核心团队由国内外互联网、云计算头部公司以及传统网络、芯片、安全头部厂商的资深专家组成,拥有DPU设计与研发及DPU大型商业化部署的成功经验。

大禹智芯Paratus系列DPU产品采用三条产品线并行的方式逐步面向广泛商用市场推出易用并好用的DPU产品:

- Paratus 1.0作为大禹智芯DPU的第一条产品线产品,采用ARM SoC作为主处理单元,提供多个10Gbps/25Gbps的业务网络接口,同时为了方便用户管理,单独设置了RJ45管理口。

- Paratus 2.0作为大禹智芯DPU的第二条产品线产品,采用ARM SoC + FPGA的硬件架构,在Paratus 1.0产品基础上,利用FPGA对可固化逻辑的数据包实现高性能转发,提供多个10G/25G、100G的业务网络接口。

- Paratus 3.0作为第三条产品线产品,将采用大禹智芯自研DPU芯片。该芯片将结合公司对DPU相关技术及未来应用场景的理解,和前两条产品线(Paratus 1.0和Paratus 2.0)在实际场景部署中获得的宝贵客户反馈意见和经验积累,形成高度集成化的DPU产品。

官网:https://www.dayudpu.com/