明敏 发自 凹非寺 量子位 | 公众号 QbitAI

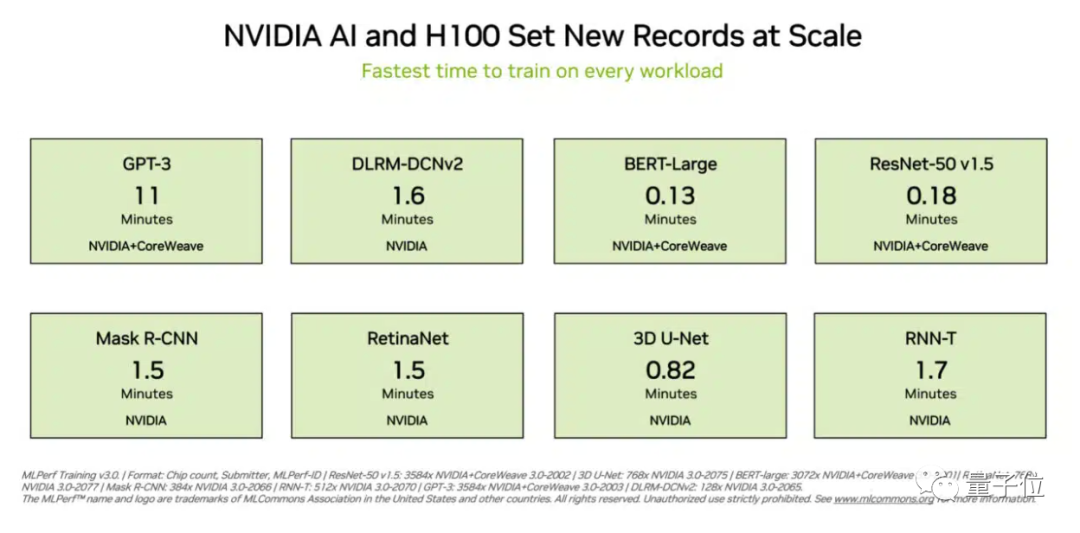

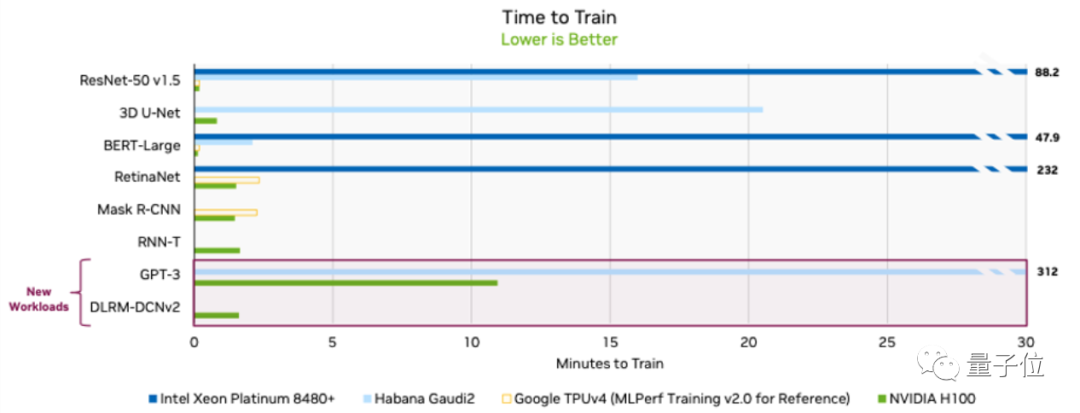

11分钟内训练一遍GPT-3,8秒训完BERT。

这就是英伟达给AI圈的一点“小小震撼”。

在最新MLPerf训练基准测试中,英伟达H100集群,横扫八项测试,全部创下新纪录,并且在大语言模型任务中表现尤为突出!

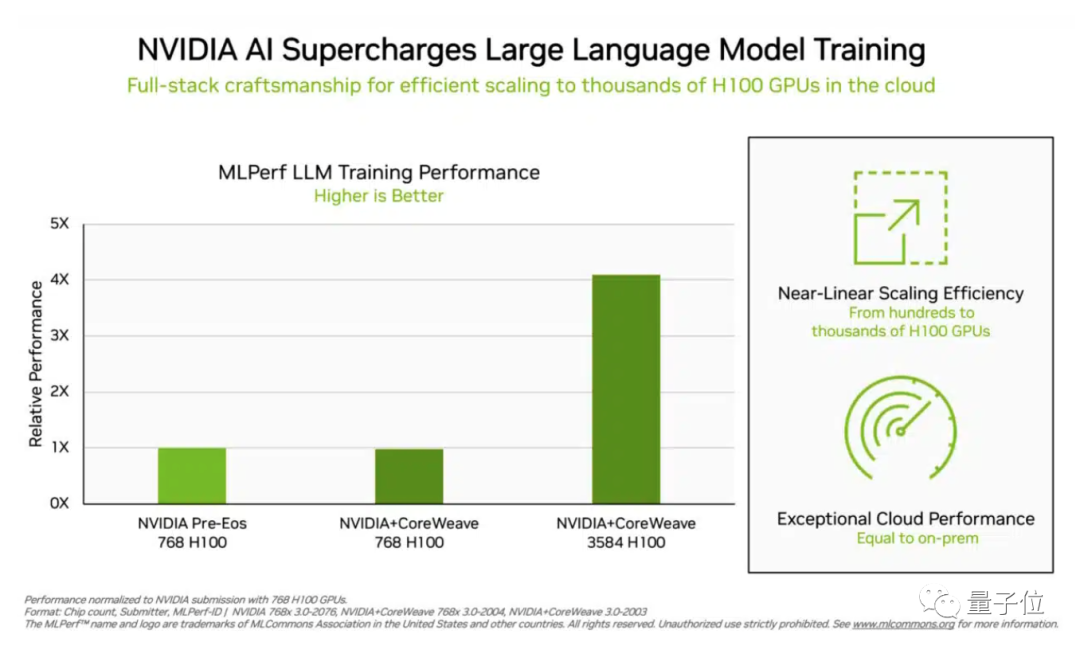

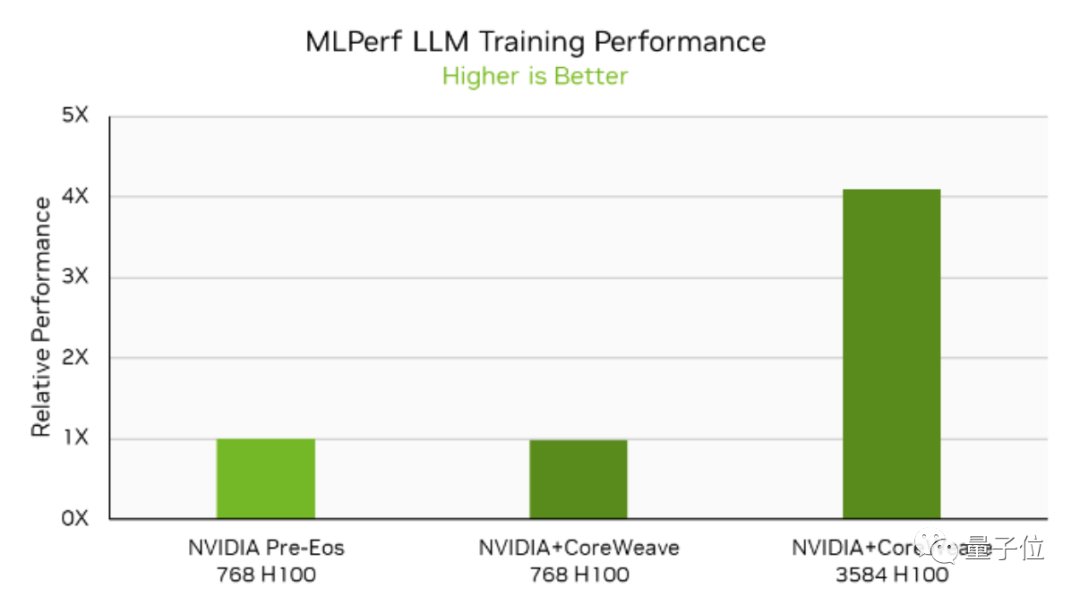

在大语言模型任务中,H100集群的加速性能逼近线性增长。

即随着集群处理器数量增加,加速效果也几乎同比增加。

这意味着在集群内GPU之间的通信效率非常高。

除此之外,H100还完成了推荐算法、CV、医学图像识别以及语音识别等任务,是唯一一个参加8项测试的集群。

而在算力就是生产力的时代下,这波成绩意味着什么,懂得都懂。

据悉,本次测试系统由英伟达和Inflection AI联合开发,在云厂商CoreWeave上托管。

单节点性能增长明显

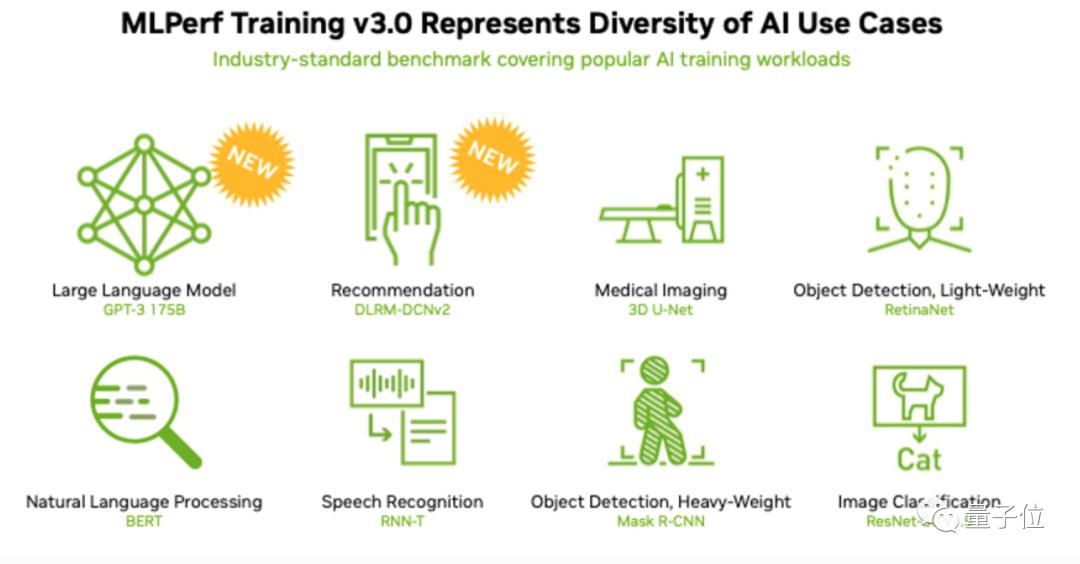

这次MLPerf Training v3.0中增加了两项新任务:

- 大语言模型(基于GPT-3)

- 推荐算法

这意味着测试任务包含了更大的数据集和更先进的模型。

如上刷新各项记录的,是由3584块H100组成的超大集群。

它的具体成绩如下:

这是本轮测试中,英伟达拿出的最大集群。

实际上他们还提交了一个包含768块H100的集群进行测试,并分别在云上和本地部署。

结果显示二者性能几乎完全相同。

更进一步还论证了随着集群中显卡数量的增加,其性能提升可以接近线性增长。

(NVIDIA Pre-Eos为本地部署,NVIDIA+CoreWeave为云上部署)

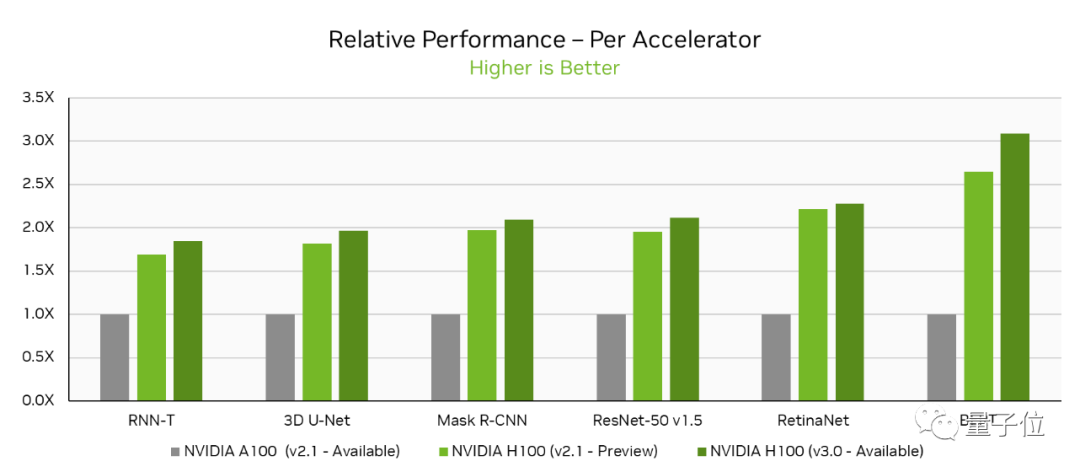

除此之外,这轮测试中英伟达还刷新了单节点加速记录。

和6个月前MLPef Training v2.1的数据比较,单个DGX H100系统(8块H100组成)在各项任务中平均提速17%。

和A100 Tensor Core GPU相比,最高能提速3.1倍(BERT任务)。

这些加速效果的实现,主要得益于两个方面。

一方面是H100本身就足够强悍。

H100基于最新Hopper架构,采用台积电4nm工艺,集成800亿个晶体管,较A100增加了260亿个。

内核数量达到前所未有的16896个,是A100的2.5倍。

由于面向AI计算,H100中专门搭载了Transformer Engine,让大模型训练速度可直接×6。

另一方面则是依赖集群内的加速网络。

这里使用的是英伟达Quantum-2 InfiniBand网络,是该网络架构的第七代。

官网介绍,加速网络能够提供软件定义网络、网络内计算、性能隔离、优越加速引擎、RDMA和最快达400Gb/s的安全加速。

据悉,共有90个系统参与最新一轮测试,其中82个使用了英伟达的GPU,英特尔方面有7个系统参与。

英特尔的加速系统使用了64-96 Intel Xeon Platinum 8380处理器和256-389 Intel Habana Gaudi2加速器。

其高配系统完成LLM的训练时间为311分钟。

基于这次报告的测试结果,有分析师表示他感受到的最大震撼不是H100本身的性能,而是在云上训练AI实现的卓越效果。

那么这次和英伟达合作的云厂商CoreWeave是谁?联合开发系统Inflection AI又来者何人?

计算集群还会进一步扩大

首先来看CoreWeave。

它成立于2017年,是一家大型云厂商,号称提供业内最快、最灵活的大规模GPU计算资源,提供渲染、机器学习等云上方案,速度比大型公共云快35倍,成本低80%。

而这家云厂商很受科技巨头青睐,英伟达在此之前没少cue过它。

5月,CoreWeave拿下2亿美元融资,主要来自对冲基金Magnetar Capital,B轮总融资额达到4.21亿美元。

6月,有消息称微软与CoreWeave签署AI算力协议,用于计算基础设施,未来数年内的投资金额可能数十亿美元。

英伟达也向CoreWeave投资了1亿美元,4月时它的估值为20亿美元。

另一家AI初创公司Inflection AI由DeepMind创始成员穆斯塔法·苏莱曼(Mustafa Suleyman)等人创立。

这家公司成立于22年3月,已拿下2.25亿美元融资,估值超12亿美元。

公司已经开发出了一个大语言模型Pi,正是在H100集群上训练出来的。

据了解,Pi的定位是帮助人类更好和计算机交互,它能通过聊天内容来逐渐了解用户,然后提供更加个性化的回答,类似于个人智能管家的感觉。

Inflection AI的最新Blog里表示,基于目前的合作,他们计划在未来几个月内进一步扩大底层计算基础设施的规模。