机器之心原创

作者:黄小天

9 月 2 日,德国柏林 IFA 2017 电子展上,华为消费者业务 CEO 余承东推出全球第一款手机端 AI 芯片麒麟 970(Kirin 970),以芯、端、云协同发展战略积极部署移动端 AI 生态,在演讲中,描绘了一幅浩瀚未知而又令人芯驰神往的未来图景。

25 日,华为在北京召开媒体沟通会,华为 Fellow 艾伟对 Kirin 970 作了进一步的深度解读;十年来,从 K3V1 到 Kirin 970,华为芯片一路走来,坚守 SoC 策略,持续集成,异构创新;坚持用户体验优先,奋力实现从智能到智慧的转变。下文是机器之心对 Kirin 970 媒体沟通会的报道,希望读者对这颗「中国芯」有更多了解。

Mobile AI

如果说移动端 AI 革命已经兴起,那么华为 Kirin 970 无疑是打响了第一枪。华为把 Kirin 970 比做智能手机的「新大脑」,它是实现最终智能体验「Mobile AI=On-Device AI+Cloud-AI」的关键;有了 Kirin 970,华为的芯、端、云战略才能免于空谈,并为后来的移动端 AI 生态布局打下坚实基础,形成商业闭环。

Kirin 970 CPU 采用 big.LITTLE 架构,内置 4 个用于处理重负载任务的 Cortex A73 核心,4 个 Cortex A53 核心,GPU 则为全新一代具有 12 个核心的 Mali-G72 MP12,所有参数都达到了旗舰产品级别;采用台积电(TSMC)10nm 制程工艺,晶体管总数达 55 亿;支持全球最高的通信规格 LTE Cat.18/Cat.13,实现了业界最高的 1.2Gbps 峰值下载速率;同时升级了自行研制的 ISP,并且在前一代双摄 ISP 的基础上进行了全面升级,其针对特定场景进行了性能和效果优化,可帮助使用者拍出更自然、更美的照片。在硬件参数的升级之外,Kirin 970 最引人关注的新特性就是全新设计的 HiAI 移动计算平台了。

训练与推断

想象一下,如果 AI 是《疯狂动物城》里的树懒「闪电」,这个世界会怎么样?答案是 AI 将销声匿迹。自 1956 年 AI 诞生以来,三起两落也罢,百家争鸣也罢,人类始终最希望的是 AI 能够快速地「学以所用」:不仅要快速地学习知识(训练),还能快速地应用知识(推断),让知识在瞬间爆发出来,这样 AI 才能为人所用。所以,对知识的及时处理是 Mobile AI 应用的关键。

这意味着 Kirin 970 作为手机端 AI 芯片要在知识处理,即推断上猛抓,且做足功夫,因为全球人工智能的基本趋势是企业级市场依然是一门「云生意」,毫无变革念头;消费级市场则正在从云端下沉到终端,华为以及苹果、三星等抢占的正是这块高地。令人欣慰的是 Kirin 970 在 Mobile AI 方面确实是先声夺人、先人一步。

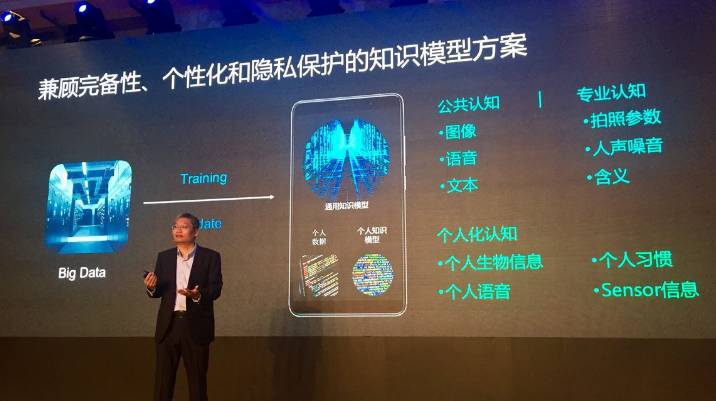

那么,华为如何提供一套兼顾完备性、个性化和隐私保护的知识模型方案呢?

在日常生活中,人类需要个体智慧和集体智慧相互协同产生更巨大的力量;而未来的智慧终端想要不断地发展,相应的 AI 体系除了要充分发挥终端自身的能力和价值,也要结合大数据和云技术带来的海量信息、服务和超强计算力,如此才能整合通用知识模型与个人知识模型,激发出移动端 AI 在训练与推断方面的双料潜力。所以不会存在纯粹终端的 On-Device AI,否则知识模型的完备性将会丧失。

全球化时代背景下,个性化显得越发珍贵;在手机中,个性化更是提升用户体验的重头戏。一般来讲,云端多以训练为主,终端多以 Inference 推断为主,华为的当前这代 NPU 作为一款 AI 加速器则侧重加速端侧推断能力。接下来后面如果 NPU 或者 GPU 可以通过个人数据自我训练,那么手机就具备了学习能力,它吸取的个人数据越多就越智能,越个性化,越懂我。并真正做到学以所用,而最重要的是这一切发生在本地终端,省去了隐私泄漏的担忧。

性能与功耗

今年 5 月份谷歌推出 TPU 2.0。TPU 是谷歌研发的一款深度学习加速 ASIC 芯片,第一代 TPU 仅支持推断(即不可用于训练模型),并在 AlphaGo 人机大战中提供了致胜的算力支撑。目前 TPU 2.0 除推断以外,还能高效支持训练环节的深度学习加速。据谷歌披露,32 块 GPU 并行训练一整天而完成的深度学习翻译模型训练任务,只需在 TPU2.0 上通过 1/8 TPU Pod(TPU 集群,每 64 个 TPU 组成一个 Pod)就能在 6 小时内完成。

同样在今年 5 月,英伟达在 2017 GPU 技术大会(GTC 2017)上正式发布新一代处理器架构 Volta V100,「Volta 并不是 Pascal 的升级,而是一个全新的架构!」英伟达应用深度学习研究副总裁 Bryan Catanzaro 如是说。英伟达通过该架构耗资 30 亿美元打造了一款深度学习加速器 Tesla V100,其采用台积电(TSMC)12nm FFN 专属工艺,包含 211 亿个晶体管,速度超越 100TFlops,英伟达号称这是全球最先进的数据中心 GPU,主打企业级超大规模深度神经网络加速。

以上是 2017 年业界对 AI 处理性能探索的两个典型代表,Tesla V100 与 TPU2 作为服务器端的 AI 芯片性能无可挑剔,但前提是它们没有尺寸的考虑和功耗方面的明显限制,可以一直插着电,并配有先进的降温系统,这些要求手机端的 AI 芯片显然无法满足。大家知道 Kirin 970 含有 55 亿个晶体管,那么它们是如何封装进指甲那么小的空间呢?并且需要同时保证性能与能耗甚至还有所提升,这一切不能超出手机电池的承受范围,其难度可想而知。除此之外,Kirin 970(CPU、GPU、NPU、ISP、DSP)还需要考虑实际 APP 的各种需求,难度就更大了。

面对这一问题,华为如何实现从服务器端到手机端的跨越呢?答案是华为在传统解决方案 SoC 的深厚积淀之上,创造性地提出了「HiAI 异构架构」,非常好地异构融合了 CPU、GPU、NPU、ISP 与 DSP,在处理同样 AI 应用任务时,拥有大约 25 倍性能和 50 倍能效优势,使 Kirin 970 成为了名副其实的全球首款手机端 AI 芯片和 AI 计算平台。

挑战

Kirin 970 之后,苹果随后也推出了手机端 AI 芯片 A11,以及搭载该芯片的 iPhone X、iPhone 8、iPhone 8 Plus,后来居上。华为与苹果在移动端 AI 方面抢占了其他手机厂商如三星、小米的先机,那么两家之间孰优孰劣呢?苹果无疑是 Kirin 970 目前面临的最大挑战。

安卓与 iOS

安卓与 iOS 之间的拉锯战迎来了新的范式转换——手机端 AI 芯片。这一次的变革天然有利于苹果 iOS。一个完整的手机生态需要算力+开发+硬件,三者缺一不可。苹果软硬件高度一体化的封闭生态很适合把 A11 芯片的强大算力顺利导给开发者,而开发者借助强大算力把想法通过硬件实现出来,从而形成一个良性循环、上下游多赢的局面,最终带来收获口碑的不二王道——绝佳的用户体验。

而安卓系统的开放性所带来的天然缺陷恰恰是无法把 AI 芯片的强大算力从底层顺利导向开发和硬件,从而使得算力打折扣。庆幸的是采用安卓系统的华为手机(以及其他国内手机如小米)通过去 GMS 在相当程度上克服了安卓系统的缺陷,这样华为在手机系统上并未失利,苹果华为几乎在同一起跑线上,两家真正的共同挑战在于应用场景与共同体验。从过往的手机体验以及 iPhone X、iPhone 8、iPhone 8 Plus 的最新表现来看,华为 Mate 10 似乎承受着不小的压力。

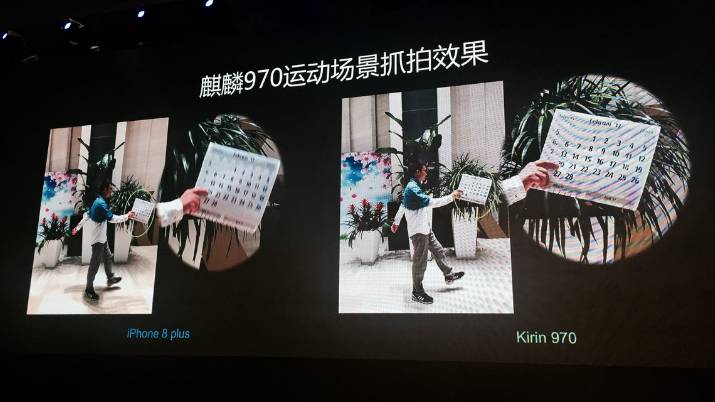

这次的沟通会上,华为给出了一个不正常的对标。通过多张拍照效果对比,华为证明 Kirin 970 在拍照上完爆 iPhone 8 Plus。注意,华为给出的对标是自家的芯片与别家的手机,这显然不对。其实华为真正想说的是 Kirin 970 要比苹果 A11 牛,不仅是在拍照效果上,在相同网络模型下每分钟识别的图像数量上也是如此(Kirin 970 为 2005 张,iPhone 8 Plus 为 889 张)。Kirin 970 的 AI 性能优于 A11 是可信的,但这并不意味着华为 Mate 10 的最终性能和用户体验同样优于 iPhone 8 Plus,这才是问题的关键。

HiAI 移动计算平台

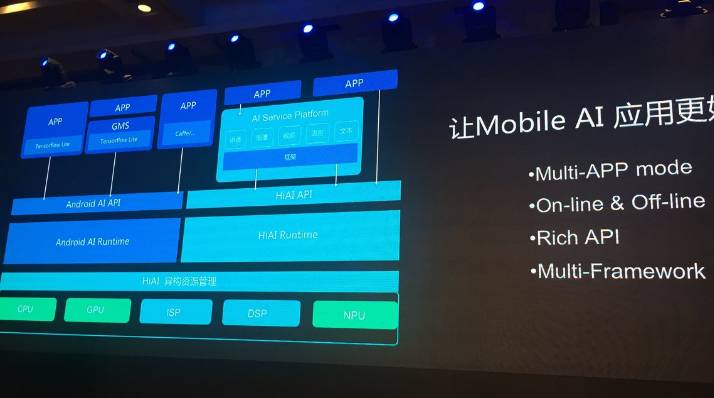

华为 Mate 10 未出,目前一切皆是「云测评」。或许只有等到 Mate 10 出来,答案才能揭晓。但这显然不是手机端 AI 的最后答卷,两家都有着先发红利,把握先机、吸引开发者打造爆款应用才是当务之急。Kirin 970 完爆 A11,固然不错,但 HiAI 移动计算平台才是当下华为手机的真正利器。

HiAI 移动计算平台推出的最终目的在于把 Kirin 970 的 AI Computing 的能力开放出来,期望更多的 AI 合作伙伴与开发者探索更好的应用。可以说这是大势所趋,华为别无二择。Kirin 970 的推出使得华为在移动端 AI 芯片上先发制人,堪称惊艳,但后续的应用场景同样关键,华为如何做到继续领先呢?唯有走场景生态的路子,迅速培育出利用 NPU 计算力的杀手级应用,形成商业闭环。HiAI 移动计算平台可谓这次 Kirin 970 沟通会的唯一重头戏。

本文为机器之心原创,转载请联系本公众号获得授权。