代码地址:在公众号「3D视觉工坊」,后台回复「PREDATOR」,即可直接下载。

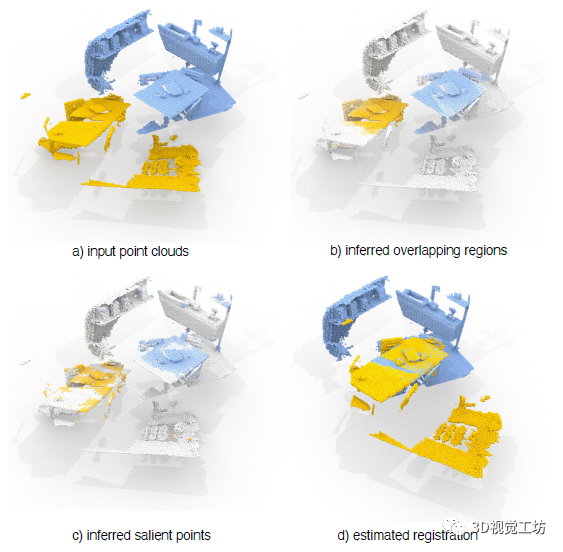

图1 PREDATOR的将注意力集中在重叠区域,并选择该区域的显著点,以便在低重叠情况下仍能进行鲁棒配准。

针对的问题:

1.实际应用中很多情况点云是低重叠的。例如在狭窄的走廊上移动时或者在密集的建筑区域,森林等处移动,又例如考虑到数据采集的昂贵成本,点云采集往往追求低次数的扫描,只有必要的重叠。

2.目前绝大多数的评价数据集都是高重叠率的点云数据,但当两个点云之间的重叠低于30%时,即使是最知名的方法的配准性能也会迅速恶化。

重要的贡献:

1. 分析为什么现有的配准体系在低重叠制度下会崩溃

2. 提出一种新颖的重叠注意块,允许两个点云之间的早期信息交换,并将后续步骤集中在重叠区域上。

3. 提出一种改进特征点描述符的方案,调节点云时也同时在对应点云上进行调节。

4. 提出了一种新颖的损失函数来训练匹配度分数,有助于更好地提取兴趣点,使兴趣点具有更强的可重复性。

算法原理:

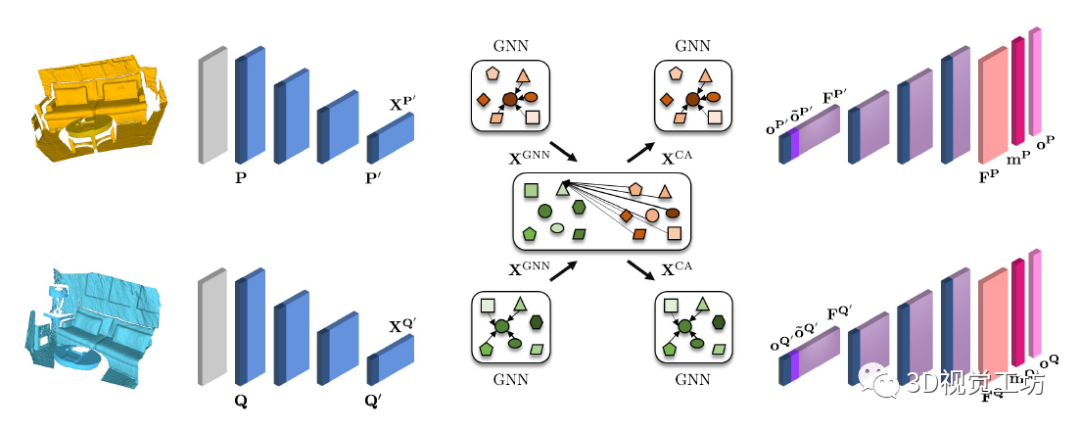

作者所提出的PREDATOR是一个双流编解码器网络。该网络的实现使用的是KPConvstyle点卷积的残差块,但是这个主干架构是不可知的,当然也可以用其他的三维卷积公式来实现。PREDATOR的体系结构可以分解为三个主要模块:

1.将两个点云编码成更小的超点集,并关联其中潜在的特征编码,共享权值。

2.重叠注意模块(在bottleneck中)提取两个点云特征编码之间的共同上下文信息,并给每个叠加点分配两个重叠分数,量化叠加点本身及其软对应在两个输入之间重叠位置的可能性。

3.将相互制约的bottleneck解码为逐点的描述符以及重叠点的匹配分数。

图2 PREDATOR的网络结构

最后,PREDATOR使用端到端的训练,用了三次损失函数。

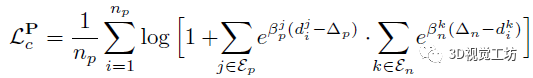

第一个是circle loss,代表圆形搜索半径内点云P和Q的对应关系损失:

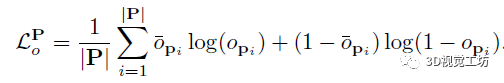

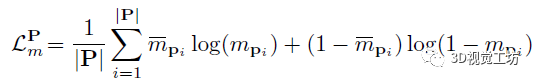

第二个是Overlap loss,代表重叠概率,对重叠概率的估计采用二值分类,并利用重叠损失进行监督:

第三个是Matchability loss,代表在训练期间的给定点与当前的特征描述符成功匹配的关键点。作者将预测转换为二值分类,并动态生成ground truth标签:

实验部分:

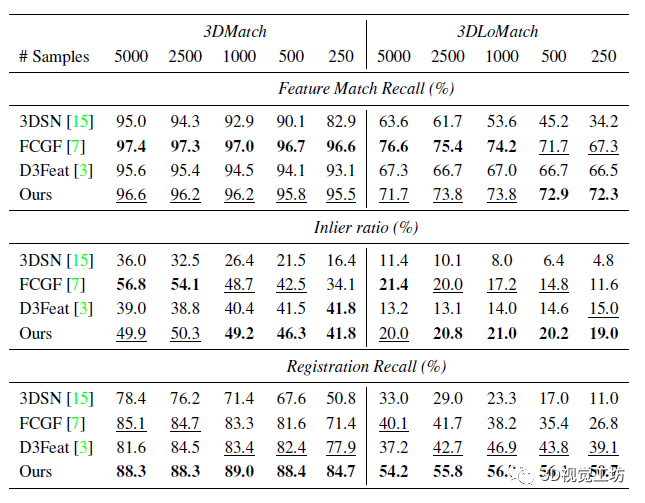

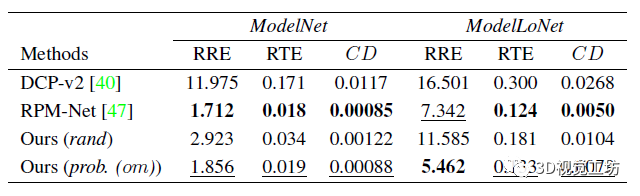

作者使用3DMatch和3DLoMatch数据集评估了PREDATOR。此外,作者比较了ModelNet40和 PREDATOR的配准性能,实验结果如下:

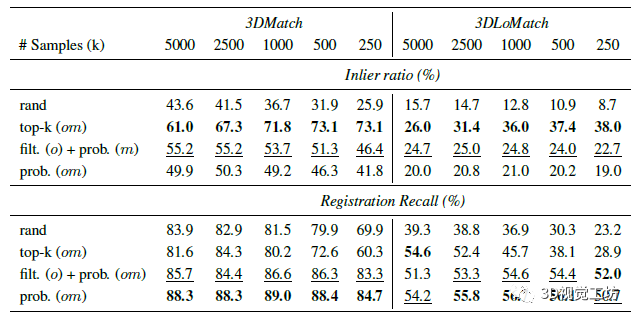

表1 不同兴趣点采样策略下的PREDATOR性能研究

表2 不同算法在3DMatch和3DLoMatch数据集上的结果

表3 ModelNet和ModelLoNet的评价结果

结论:

作者介绍了PREDATOR,一个为低重叠点云的成对配准而设计的深度学习模型。该模型的核心是一个重叠注意模块,可以在点云的潜在编码之间进行早期信息交换,从而推断哪些点可能位于重叠区域。PREDATOR可以向多个方向发展,目前它与全卷积点云编码器紧密耦合,依赖于瓶颈中有合理数量的叠加点。此外,它建立在普遍的重叠区域定义的基础之上,该定义计算具有可行对应关系的点的分数。

备注:作者也是我们「3D视觉从入门到精通」特邀嘉宾:一个超干货的3D视觉学习社区

本文仅做学术分享,如有侵权,请联系删文。

下载1

在「3D视觉工坊」公众号后台回复:3D视觉,即可下载 3D视觉相关资料干货,涉及相机标定、三维重建、立体视觉、SLAM、深度学习、点云后处理、多视图几何等方向。

下载2

在「3D视觉工坊」公众号后台回复:3D视觉github资源汇总,即可下载包括结构光、标定源码、缺陷检测源码、深度估计与深度补全源码、点云处理相关源码、立体匹配源码、单目、双目3D检测、基于点云的3D检测、6D姿态估计源码汇总等。

下载3

在「3D视觉工坊」公众号后台回复:相机标定,即可下载独家相机标定学习课件与视频网址;后台回复:立体匹配,即可下载独家立体匹配学习课件与视频网址。